Edge AI com Grace Blackwell no DGX Spark

Edge AI de Alto Desempenho com NVIDIA DGX Spark e Grace Blackwell

Introdução: A Nova Fronteira da Supercomputação no Edge

A aceleração da inteligência artificial generativa criou uma ruptura estrutural na forma como empresas desenvolvem, testam e implantam modelos de larga escala. O crescimento de modelos com dezenas ou centenas de bilhões de parâmetros impôs uma dependência quase absoluta de data centers massivos e infraestrutura cloud de alto custo.

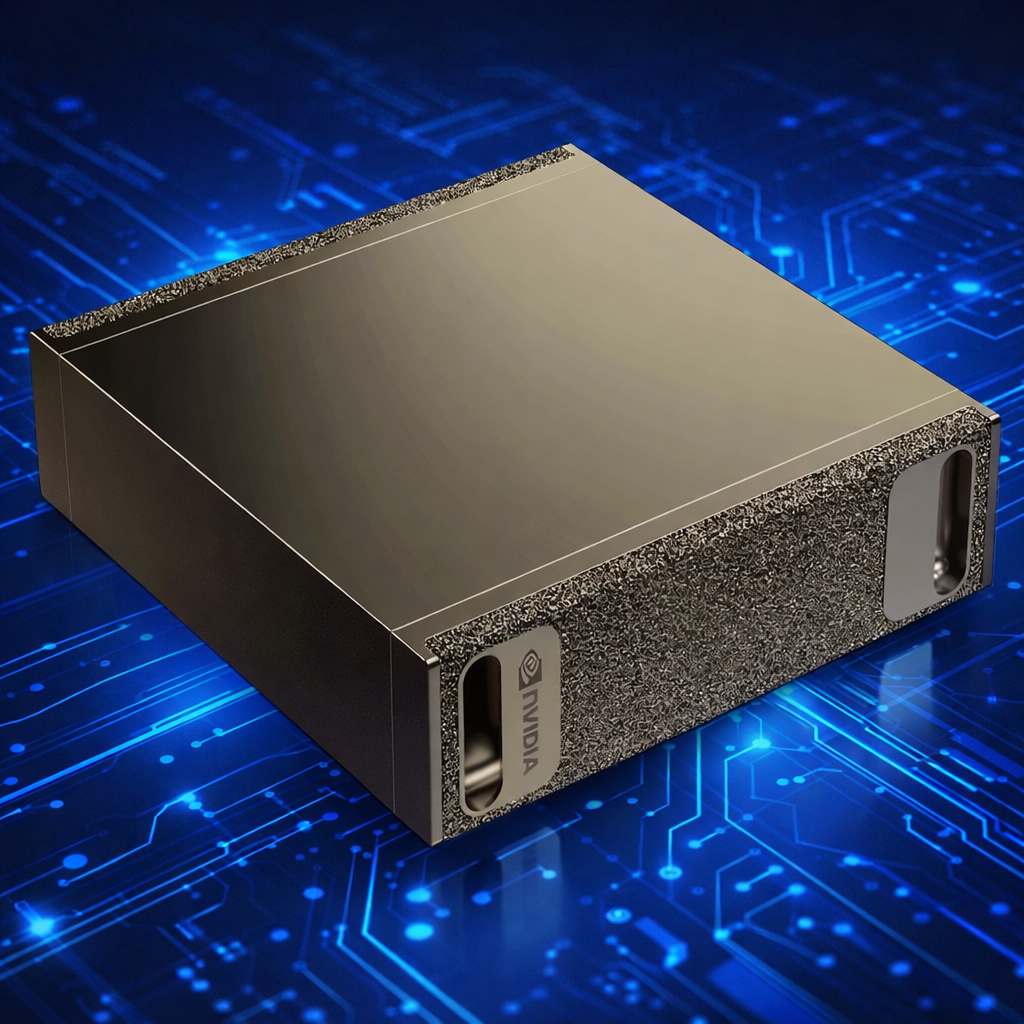

Nesse contexto, o NVIDIA DGX Spark surge como uma proposta disruptiva: trazer a arquitetura Grace Blackwell para um formato compacto de mesa, entregando até 1 petaFLOP de desempenho de IA FP4 em um sistema com 128GB de memória unificada. Trata-se de uma redefinição do conceito de Edge AI de alto desempenho.

O desafio empresarial não é apenas executar modelos grandes. É prototipar, ajustar, validar e iterar rapidamente sem depender exclusivamente da nuvem. Custos recorrentes, latência, questões de privacidade e governança de dados tornaram-se fatores críticos de decisão estratégica.

Este artigo analisa profundamente como o NVIDIA DGX Spark, equipado com o superchip GB10 Grace Blackwell, altera o equilíbrio entre computação local e infraestrutura centralizada, explorando arquitetura, desempenho, largura de banda, integração CPU-GPU e implicações estratégicas para organizações orientadas por IA.

O Problema Estratégico: Dependência Excessiva de Infraestrutura Centralizada

Limitações das GPUs tradicionais no desenvolvimento local

Mesmo GPUs de ponta como a RTX 5090 possuem apenas 32GB de memória dedicada. Modelos LLM de última geração frequentemente excedem essa capacidade com facilidade, especialmente quando o contexto aumenta durante sessões prolongadas.

O esgotamento de VRAM torna-se um gargalo estrutural. Além disso, à medida que o comprimento de contexto cresce, a pressão sobre a memória se intensifica, impactando diretamente a taxa de geração de tokens.

Como consequência, desenvolvedores são forçados a recorrer a produtos profissionais extremamente caros ou a ambientes cloud, elevando custos e reduzindo autonomia.

Consequências da Inação

Organizações que mantêm dependência total da nuvem enfrentam:

– Custos operacionais crescentes

– Latência em ciclos de desenvolvimento

– Riscos de exposição de dados sensíveis

– Limitação na experimentação de modelos abertos de grande porte

O Edge AI de alto desempenho surge como resposta estratégica a essa fragilidade estrutural.

Fundamentos da Solução: Arquitetura NVIDIA Grace Blackwell

Superchip GB10: Integração CPU-GPU Coerente

O núcleo do DGX Spark é o superchip NVIDIA GB10, combinando uma CPU ARM com 20 núcleos (10 Cortex-X925 e 10 Cortex-A725) com uma GPU Blackwell de 6.144 CUDA cores e 192 Tensor Cores de quinta geração.

Ambos os chiplets são fabricados em nó de classe 3nm e interconectados via NVLink-C2C coerente de alta largura de banda, permitindo compartilhamento eficiente da memória unificada.

Essa integração elimina a separação tradicional entre memória de sistema e VRAM, alterando o paradigma clássico de estações com GPU discreta.

128GB de Memória Unificada Coerente

O DGX Spark incorpora 128GB LPDDR5x unificada com interface de 256 bits e largura de banda de 273GB/s. Embora inferior à largura de banda GDDR6X de GPUs topo de linha, a estratégia arquitetural compensa via uso de precisão FP4.

Essa capacidade permite executar localmente modelos de até 200 bilhões de parâmetros, algo inviável em estações tradicionais sem múltiplas GPUs.

NVFP4: A Revolução da Precisão de 4 Bits

A arquitetura Blackwell introduz suporte a NVFP4, formato proprietário de 4 bits otimizado para inferência. O DGX Spark entrega até 1 petaFLOP de desempenho FP4 esparso.

A redução de precisão diminui drasticamente o consumo de memória e largura de banda por parâmetro, viabilizando a execução de modelos massivos no edge.

Esse é o ponto de inflexão técnico que permite a democratização de modelos com centenas de bilhões de parâmetros.

Desempenho Real: Análise Crítica de Benchmarks

Prefill vs Decode

Benchmarks com modelos GPT-OSS 120B demonstram desempenho expressivo na fase de prefill (1.723 tokens/s em MXFP4), superando inclusive um rig com 3x RTX 3090 nessa etapa.

Entretanto, na fase de geração (decode), o desempenho cai para aproximadamente 38 tokens/s, refletindo a limitação de largura de banda da LPDDR5x.

Esse comportamento confirma o trade-off estrutural: capacidade massiva de memória versus throughput máximo sustentado.

Clusterização via ConnectX-7

A NIC ConnectX-7 integrada suporta até 100Gb Ethernet e portas QSFP de até 200Gbps, permitindo clusterizar dois DGX Spark para trabalhar com modelos de até 405 bilhões de parâmetros.

Esse recurso amplia a escalabilidade horizontal no edge, aproximando o desktop de conceitos tradicionalmente restritos a data centers.

Implementação Estratégica em Ambientes Corporativos

Edge AI com Governança de Dados

Manter modelos sensíveis localmente reduz exposição de dados estratégicos. Casos como assistentes internos, análise jurídica, P&D e prototipagem confidencial se beneficiam diretamente.

A presença do DGX OS baseado em Ubuntu 24.04 LTS garante compatibilidade com padrões corporativos de segurança e atualização.

Integração com Workflows Existentes

O suporte completo ao ecossistema CUDA, TensorRT-LLM e containers NVIDIA reduz fricção de migração. Diferentemente de plataformas que exigem adaptação para ROCm ou Metal, o Spark preserva continuidade operacional.

Remote Access e Headless Deployment

Ferramentas como NVIDIA Sync permitem acesso remoto via SSH, possibilitando uso headless ou integração com redes privadas via Tailscale.

Trade-offs Técnicos e Limitações

Custo

Com preço aproximado de US$ 3.999 na versão Founders Edition, o DGX Spark posiciona-se acima de alternativas como AMD Strix Halo (~US$ 2.348).

Largura de Banda

A limitação a 273GB/s impacta a fase de geração de tokens, tornando rigs multi-GPU superiores em throughput bruto.

Uso Especializado

O DGX Spark não é projetado como substituto de workstation generalista ou máquina de gaming. Seu valor está concentrado no desenvolvimento de IA.

Impacto Estratégico: Democratização da IA Avançada

A principal implicação do DGX Spark é a descentralização da experimentação em IA. Ao permitir execução local de modelos de até 200B parâmetros, ele reduz barreiras técnicas e financeiras associadas à nuvem.

Instituições de pesquisa, startups e equipes corporativas passam a ter acesso a infraestrutura que antes exigia racks dedicados.

Essa mudança tende a acelerar ciclos de inovação, aumentar autonomia e reduzir dependência de hyperscalers.

Conclusão: Supercomputação Pessoal como Estratégia Competitiva

O NVIDIA DGX Spark com arquitetura Grace Blackwell representa uma inflexão no conceito de Edge AI de alto desempenho.

Ao combinar 128GB de memória unificada, suporte a NVFP4 e integração CPU-GPU coerente via NVLink-C2C, o sistema viabiliza a execução local de modelos massivos antes restritos a ambientes de data center.

Embora apresente trade-offs claros em custo e largura de banda, seu posicionamento como laboratório de IA em formato desktop é estrategicamente consistente.

Para organizações cujo diferencial competitivo depende de experimentação rápida e controle sobre dados, o Edge AI com Grace Blackwell deixa de ser tendência e passa a ser infraestrutura crítica.