Servidor ASUS XA NB3I-E12 com NVIDIA HGX B300: desempenho extremo para IA empresarial e CSPs

Introdução: a nova era da computação acelerada

No cenário atual de inteligência artificial e computação em larga escala, o poder de processamento deixou de ser apenas uma questão de desempenho bruto e passou a representar a capacidade de transformar dados em vantagem competitiva. O ASUS XA NB3I-E12 com NVIDIA HGX B300 surge como um marco nesse contexto — uma plataforma arquitetada para cargas de trabalho intensivas de IA generativa, aprendizado profundo e HPC, projetada para atender desde provedores de nuvem (CSPs) até grandes corporações, instituições de pesquisa e setores como financeiro e automotivo.

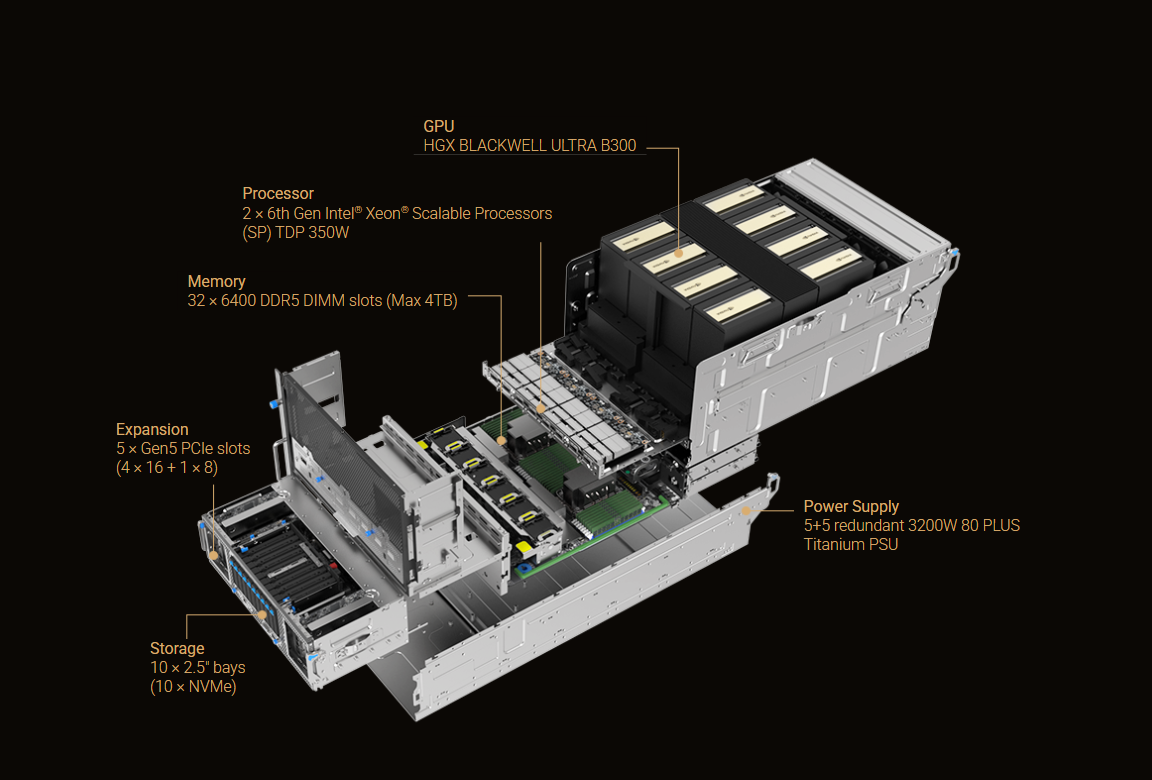

Mais do que um servidor, o XA NB3I-E12 representa a materialização de uma visão: a convergência entre desempenho extremo, eficiência energética e escalabilidade modular. Com 8 GPUs NVIDIA Blackwell Ultra integradas em uma placa HGX B300, conectividade InfiniBand embutida e processadores Intel Xeon 6 de última geração, ele redefine o padrão de computação acelerada no data center moderno.

Nas seções a seguir, exploramos em profundidade os fundamentos técnicos, a lógica de design e as implicações estratégicas dessa arquitetura para ambientes corporativos e de pesquisa que dependem de IA em escala.

O problema estratégico: os limites da infraestrutura convencional de IA

Modelos de IA generativa e LLMs de última geração, como os com centenas de bilhões de parâmetros, desafiam as infraestruturas tradicionais. O gargalo não está apenas na capacidade de processamento, mas na interconexão entre GPUs, na latência de comunicação e na eficiência energética de clusters cada vez mais densos.

Empresas e provedores de nuvem enfrentam o dilema de como equilibrar desempenho, consumo energético e custo operacional. As soluções anteriores baseadas em arquiteturas Hopper ou Ampere já atingiam seu teto de escalabilidade quando o volume de dados e o tamanho dos modelos ultrapassavam limites práticos de throughput e interconexão.

É nesse ponto que o ASUS XA NB3I-E12 com HGX B300 se diferencia — não apenas pela força computacional, mas pela coesão entre GPU, CPU, memória e rede, formando uma base homogênea para IA empresarial em escala.

Consequências da inação: custo e obsolescência tecnológica

Ignorar a evolução das plataformas aceleradas implica riscos significativos. Ambientes que mantêm infraestrutura baseada em GPUs de gerações anteriores enfrentam tempos de treinamento até 4 vezes maiores e custos energéticos que inviabilizam o TCO (Total Cost of Ownership) a médio prazo.

Além disso, a ausência de interconexões de alta largura de banda limita o paralelismo entre GPUs, reduzindo a eficiência em workloads distribuídos. Em um mercado em que o tempo de inferência e o custo por token processado determinam vantagem competitiva, permanecer com hardware legado representa não apenas perda de performance, mas de relevância estratégica.

Fundamentos da solução: arquitetura HGX B300 e o equilíbrio entre potência e eficiência

O coração do ASUS XA NB3I-E12 é o módulo NVIDIA HGX B300, equipado com GPUs Blackwell Ultra. Essa geração marca uma ruptura com o paradigma anterior, integrando a segunda geração do Transformer Engine com núcleos Tensor otimizados e suporte nativo a FP8, o que permite ganhos de até 4x no treinamento e até 11x na inferência em comparação à geração Hopper.

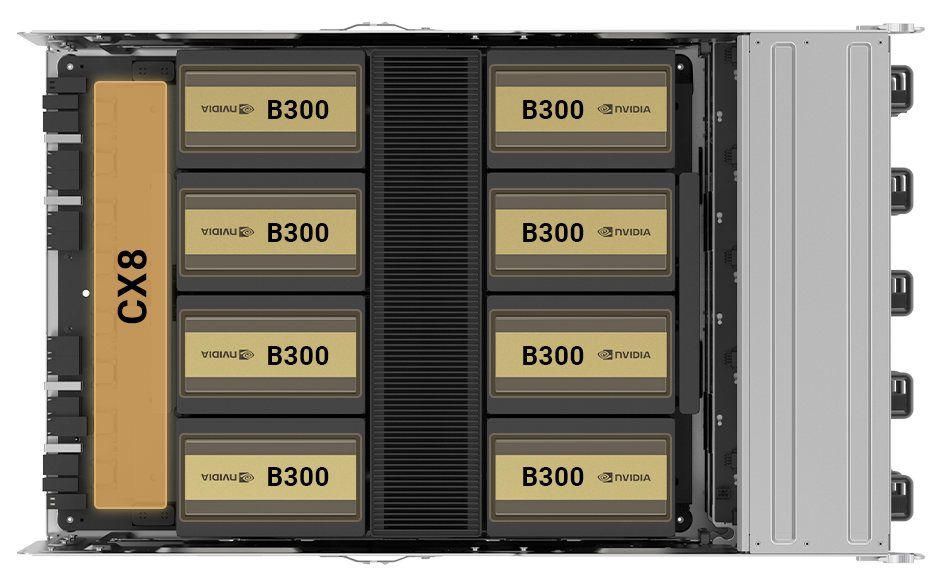

O diferencial técnico está na interconexão NVLink de 5ª geração, que atinge impressionantes 1,8 TB/s de largura de banda GPU a GPU. Esse backbone interno elimina gargalos de comunicação, permitindo que as 8 GPUs operem como um único sistema lógico coerente — essencial para o treinamento de modelos de larga escala e workloads intensivos de inferência.

Complementando o conjunto, o sistema incorpora dois processadores Intel Xeon 6 com arquitetura P-core e suporte a DDR5 6400 MHz, garantindo um canal de dados amplo e consistente para as GPUs. O suporte a 32 DIMMs e até 4 TB de RAM oferece base sólida para lidar com datasets complexos e pipelines de IA em tempo real.

Com até 10 unidades NVMe de baixa latência, a arquitetura também elimina gargalos de I/O, mantendo o fluxo contínuo de dados do armazenamento para as GPUs — requisito essencial em treinamentos com grandes volumes de dados.

Implementação estratégica: modularidade e escalabilidade no data center

A arquitetura do XA NB3I-E12 foi projetada com modularidade e escalabilidade como princípios centrais. O chassi suporta 5 slots PCIe Gen 5 (4×16 + 1×8), garantindo flexibilidade para adicionar aceleradores, controladoras de rede adicionais ou unidades de expansão conforme o crescimento das demandas.

O elemento distintivo é a integração de 8 portas InfiniBand CX8 diretamente em cada GPU, com suporte a até 800G/s por SXM. Essa integração reduz drasticamente a dependência de NICs adicionais e simplifica a topologia de rede interna, reduzindo latência, cabos e consumo energético. É uma mudança estrutural que redefine como clusters de IA são conectados e escalados.

Essa simplificação física e lógica tem impacto direto em TCO e eficiência operacional. Menos cabos significam menor dissipação térmica e menos falhas de conexão — fatores críticos para CSPs e data centers corporativos que operam 24/7.

Melhores práticas avançadas: desempenho sustentável e serviço contínuo

Além da potência bruta, o ASUS XA NB3I-E12 se destaca pela abordagem integrada de sustentabilidade. Seu design térmico otimizado e o uso de fontes redundantes de 3200W com certificação 80 Plus Titanium permitem até 20% de ganho em desempenho por TCO em comparação com a geração anterior (HGX B200), especialmente em cenários baseados em modelos como Llama MoE 10T (128K GPU).

Essa eficiência não é apenas um argumento ambiental, mas uma vantagem competitiva: em larga escala, o custo energético e o resfriamento representam parcela significativa do custo operacional. O XA NB3I-E12 entrega alto desempenho com menor impacto ambiental, promovendo uma operação sustentável sem comprometer throughput.

Em termos de manutenção, o design ergonômico e modular com parafusos sem ferramenta, riser-cards de engate rápido e tampas de liberação simples garantem intervenções mais seguras e rápidas. O resultado é menor tempo de inatividade e maior eficiência operacional em ambientes críticos.

Medição de sucesso: indicadores de desempenho e eficiência

Os resultados mensuráveis do XA NB3I-E12 se refletem em métricas de desempenho diretamente relacionadas ao valor empresarial:

- Até 11x mais desempenho de inferência em LLMs comparado à geração Hopper.

- Até 4x mais velocidade de treinamento com FP8 e precisões híbridas.

- 1.8 TB/s de interconexão NVLink entre GPUs, eliminando gargalos.

- Redução de 20% no TCO devido à eficiência energética e simplificação de cabos.

Para organizações que medem sucesso em termos de throughput por watt, tempo de treinamento ou custo por modelo, esses indicadores representam saltos significativos de produtividade e retorno sobre investimento.

Gestão e segurança: controle total sobre a infraestrutura

Com a crescente complexidade dos ambientes de IA, a capacidade de monitorar, gerenciar e proteger os ativos de hardware torna-se essencial. O XA NB3I-E12 incorpora o ASUS Control Center — uma suíte completa para gerenciamento de TI que permite monitoramento remoto, gerenciamento de energia, atualização de firmware e integração com políticas de segurança corporativas.

Além disso, o suporte a TPM 2.0 e a arquitetura de Platform Firmware Resiliency reforçam a segurança no nível de hardware, protegendo contra ataques de firmware e acesso não autorizado. Essa camada de confiabilidade é crucial para operações em ambientes de missão crítica e provedores de serviços em nuvem.

Conclusão: potência, eficiência e inteligência convergindo no data center

O ASUS XA NB3I-E12 com NVIDIA HGX B300 sintetiza o que há de mais avançado em computação acelerada para IA. Ao combinar GPUs Blackwell Ultra, processadores Intel Xeon 6 e interconexão NVLink de 5ª geração com integração InfiniBand nativa, ele oferece uma plataforma equilibrada entre desempenho extremo e eficiência sustentável.

Mais do que um salto tecnológico, representa uma resposta às necessidades reais das empresas que operam IA em escala: velocidade, confiabilidade e controle. Com essa arquitetura, provedores de nuvem e corporações podem treinar e inferir modelos complexos com menos energia, menor latência e custo operacional reduzido — alcançando o próximo nível de automação inteligente.

No horizonte, a combinação entre Blackwell, NVLink e Xeon 6 define o novo padrão de referência para data centers que buscam liderança em IA generativa e HPC. O XA NB3I-E12 é, portanto, não apenas um servidor, mas uma fundação para o futuro da computação inteligente empresarial.