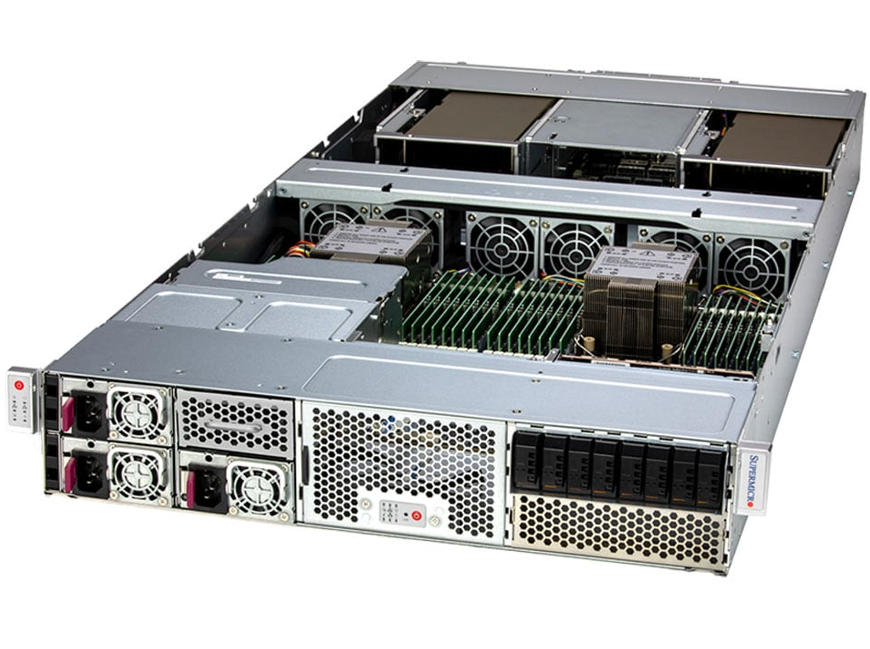

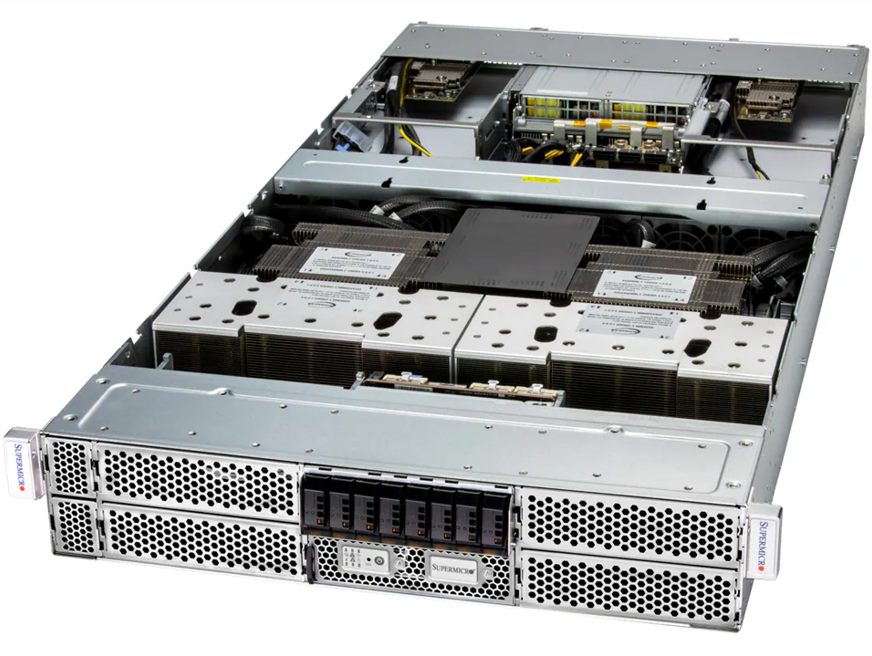

SuperServer SYS-221GE-NR: Potência Intel e NVIDIA para HPC e IA Empresarial O SuperServer SYS-221GE-NR da Supermicro representa a convergência entre processamento de alta performance e aceleração de workloads de inteligência artificial. Projetado para ambientes empresariais que exigem HPC, treinamento de deep learning e execução de LLMs, este sistema 2U entrega flexibilidade e escalabilidade, aproveitando o poder de até quatro GPUs NVIDIA e processadores Intel Xeon de 4ª e 5ª geração. Introdução: Cenário Estratégico e Desafios Empresariais No contexto atual de data centers corporativos e pesquisa avançada, a capacidade de processar grandes volumes de dados com baixa latência é crítica. Organizações que lidam com IA generativa, simulações científicas ou analytics em tempo real enfrentam desafios significativos relacionados à comunicação entre CPU e GPU, armazenamento ultrarrápido e gerenciamento térmico. A implementação inadequada de servidores GPU pode resultar em subutilização de hardware, aumento de custos operacionais e perda competitiva. Este artigo explora como o SYS-221GE-NR aborda essas questões, detalhando arquitetura, interconexões PCIe/NVLink, suporte a memória DDR5 ECC, opções de armazenamento NVMe e estratégias de gerenciamento avançado, conectando cada recurso ao impacto nos negócios. Problema Estratégico: Desafios em HPC e IA Empresarial Workloads de AI e HPC exigem throughput massivo entre CPUs e GPUs. Sistemas tradicionais muitas vezes criam gargalos de memória e I/O, limitando o desempenho mesmo com GPUs de última geração. Além disso, operações críticas dependem de alta confiabilidade, redundância e gerenciamento eficiente, áreas onde servidores de alta densidade devem se destacar. Implicações Técnicas e Comerciais Sem arquitetura adequada de interconexão, o custo por operação aumenta e o ROI do investimento em hardware de ponta é comprometido. O SYS-221GE-NR mitiga esses riscos com PCIe 5.0 x16 para CPU-GPU e opcional NVLink GPU-GPU, garantindo comunicação eficiente e escalabilidade para múltiplos workloads simultâneos. Consequências da Inação Falhas em implementar sistemas GPU otimizados podem levar a: Subutilização de GPUs: gargalos de I/O reduzem throughput e eficiência computacional. Aumento de custos operacionais: maior consumo energético e necessidade de mais servidores para workloads iguais. Risco de falhas críticas: ausência de redundância em energia ou armazenamento pode interromper operações empresariais. Fundamentos da Solução: Arquitetura e Recursos O SYS-221GE-NR combina: Até 4 GPUs NVIDIA PCIe (H100, H100 NVL, L40, L40S) com suporte opcional NVLink para interconexão de alta largura de banda. Processadores Intel Xeon 4ª/5ª geração, até 64 cores/128 threads por CPU, suportando TDP de até 350W. Memória DDR5 ECC, até 8TB, com 32 slots DIMM, garantindo alta confiabilidade e throughput consistente. Armazenamento NVMe E1.S hot-swap, até 8 drives frontais, e suporte a M.2 adicional, entregando I/O ultra-rápido. Implementação Estratégica Para maximizar a performance, recomenda-se configurar GPUs balanceadas entre PCIe 5.0 e NVLink, ajustando BIOS e firmware Supermicro para otimizar consumo energético e resfriamento. A redundância de 3 fontes de 2000W Titanium Level garante continuidade em operações críticas, enquanto ferramentas de gerenciamento como SSM, SD5 e IPMI 2.0 oferecem controle granular de hardware e monitoramento remoto. Melhores Práticas Avançadas O uso de perfis de ventilação dinâmicos, criptografia de firmware e Trusted Platform Module 2.0 permite ambientes HPC e AI seguros, reduzindo risco de ataque a nível de hardware. Estratégias de monitoramento de temperatura e controle de RPM asseguram longevidade dos componentes mesmo sob carga máxima. Medição de Sucesso Indicadores críticos incluem utilização de GPU (% de ocupação), IOPS de NVMe, latência de CPU-GPU, consumo energético por operação e uptime geral do servidor. Métricas devem ser monitoradas via SSM ou Redfish API para ajustes contínuos. Conclusão O SuperServer SYS-221GE-NR é um sistema 2U projetado para entregar desempenho extremo em HPC e IA, conectando recursos técnicos avançados a impactos diretos no negócio. Sua arquitetura equilibrada, redundância energética, gerenciamento de temperatura e suporte a múltiplas GPUs NVIDIA garante eficiência, escalabilidade e segurança operacional. Organizações que adotarem esta solução estarão preparadas para workloads críticos e cenários de alta demanda computacional, reduzindo riscos e otimizando ROI.

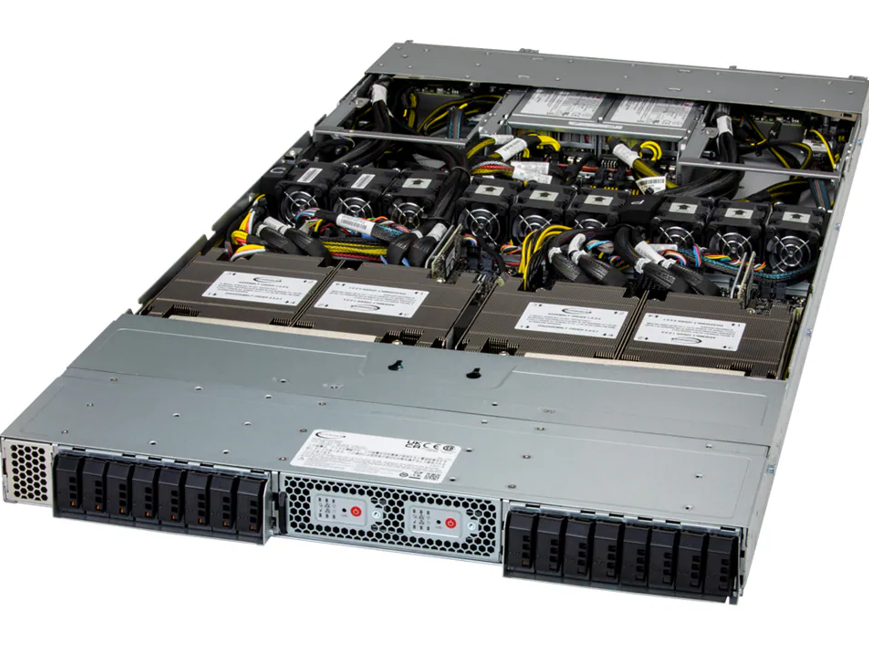

Supermicro ARS-121L-DNR: desempenho extremo com NVIDIA Grace CPU Superchip para HPC e nuvem hyperscale O avanço das arquiteturas de computação de alto desempenho redefine constantemente o equilíbrio entre densidade, eficiência energética e conectividade. O Supermicro ARS-121L-DNR emerge nesse contexto como uma solução projetada para maximizar o poder de processamento em espaços mínimos, integrando o NVIDIA Grace™ CPU Superchip e suporte a interconexões de alta largura de banda como o NVLink® Chip-2-Chip (C2C). Este artigo analisa em profundidade como o design dual-node em 1U impulsiona cargas de trabalho intensivas em dados, como High Performance Computing (HPC), aplicações hyperscale e análise avançada. Contexto e Desafio Estratégico Os datacenters modernos enfrentam uma pressão crescente por maior densidade computacional e eficiência térmica, especialmente em ambientes voltados a HPC e cloud hyperscale. O desafio está em equilibrar desempenho extremo com economia de energia e escalabilidade modular — elementos muitas vezes contraditórios na prática. O ARS-121L-DNR foi projetado exatamente para resolver essa equação, condensando dois nós completos com CPUs Grace em apenas 1U de altura. Em contextos como simulações científicas, análises de dados em tempo real e processamento paralelo massivo, a latência entre unidades de processamento se torna um gargalo crítico. A integração do NVLink C2C no ARS-121L-DNR, com 900 GB/s de interconexão bidirecional entre os processadores, elimina esse gargalo e garante que ambos os nós trabalhem em sinergia total. Consequências da Inação Ignorar a transição para plataformas otimizadas por arquitetura Grace pode resultar em desperdício de energia e limitações de throughput em cargas de HPC e IA. Sistemas baseados em arquiteturas tradicionais x86 enfrentam maior consumo energético e menor eficiência de interconexão, o que se traduz em custos operacionais mais altos e maior latência em tarefas paralelas. Além disso, em ambientes hyperscale e de análise de dados, cada microssegundo de latência impacta o custo total de propriedade (TCO). O atraso na adoção de sistemas baseados em Grace CPU Superchip reduz a competitividade frente a infraestruturas que já exploram a integração CPU-to-CPU via NVLink e memórias LPDDR5X de alta eficiência. Fundamentos da Solução Arquitetura NVIDIA Grace CPU Superchip O coração do ARS-121L-DNR é o NVIDIA Grace™ CPU Superchip, composto por duas CPUs de 72 núcleos interconectadas via NVLink C2C. Essa arquitetura elimina a dependência de controladores externos, reduzindo latência e maximizando a coerência de cache entre núcleos. O resultado é um processamento homogêneo e otimizado para tarefas paralelas em HPC, IA e data analytics. Com suporte a até 480 GB de memória LPDDR5X ECC por nó, o sistema entrega largura de banda excepcional e resiliência a falhas, garantindo integridade de dados em operações contínuas. Essa abordagem não apenas melhora o desempenho bruto, mas também contribui para a redução de consumo energético por operação computacional — um fator crítico em infraestruturas sustentáveis. Design Dual-Node em 1U O design 1U com dois nós independentes diferencia o ARS-121L-DNR no portfólio de HPC da Supermicro. Cada nó é isolado, com sua própria controladora, armazenamento, conectividade e subsistema de resfriamento, permitindo balanceamento de carga ou redundância. Isso aumenta a eficiência de rack e simplifica a manutenção sem comprometer o desempenho agregado. Essa arquitetura é particularmente vantajosa em clusters de HPC e plataformas hyperscale, onde a densidade física impacta diretamente o custo operacional por unidade de rack. Com dois servidores completos em uma única unidade de altura, a eficiência por watt e por U atinge níveis de excelência. Conectividade e Expansão de Alto Desempenho Cada nó suporta duas portas PCIe 5.0 x16, compatíveis com adaptadores NVIDIA BlueField-3 ou ConnectX-7. Essa capacidade permite configurar interconexões inteligentes (DPU) ou redes de baixa latência com largura de banda superior a 400Gb/s, ampliando o potencial do sistema em data centers orientados a IA, edge computing e virtualização de rede. O sistema também integra suporte a até 4 E1.S NVMe drives hot-swap e 4 slots M.2 NVMe por nó, oferecendo ampla flexibilidade para arquiteturas de armazenamento all-flash de baixa latência. Implementação Estratégica Eficiência Térmica e Gerenciamento Inteligente Com até 9 ventoinhas de 4 cm com controle PWM e sensores térmicos independentes, o ARS-121L-DNR mantém desempenho estável mesmo sob cargas extremas. O sistema monitora temperatura de CPU, chipset e ambiente interno, ajustando dinamicamente a rotação das ventoinhas para maximizar a eficiência térmica e reduzir ruído. O gerenciamento é suportado por AMI BIOS de 32MB SPI Flash e controladora BMC dedicada com porta LAN de 1 GbE, garantindo integração total com plataformas de monitoramento remoto e automação de datacenter. Fontes de Alimentação Redundantes Titanium Level O sistema conta com duas fontes redundantes de 2000W certificadas Titanium (96% de eficiência), oferecendo operação contínua mesmo em caso de falha de um módulo. Essa redundância é essencial em ambientes mission-critical e reduz o risco de downtime não planejado. Melhores Práticas Avançadas Integração com Ambientes Hyperscale O ARS-121L-DNR é ideal para arquiteturas em larga escala que exigem performance previsível e isolamento de carga. A segmentação dual-node permite configurar workloads independentes ou distribuir tarefas paralelas de forma coordenada, mantendo latência mínima entre nós via NVLink. Essa configuração é especialmente eficiente em clusters Kubernetes, ambientes de virtualização intensiva e soluções de AI inferencing distribuído. Governança e Confiabilidade O suporte a ECC Memory e monitoramento abrangente de saúde do sistema proporcionam conformidade com políticas corporativas de resiliência e integridade de dados. O design robusto e a gestão térmica automatizada minimizam falhas por sobreaquecimento — uma das principais causas de indisponibilidade em data centers de alta densidade. Escalabilidade Linear Graças à modularidade por nó, é possível expandir gradualmente a infraestrutura conforme a demanda computacional cresce, sem necessidade de substituição completa de chassis. Isso permite um modelo de crescimento previsível, ideal para empresas que priorizam custo operacional otimizado (OpEx). Medição de Sucesso Os indicadores de sucesso para implementações com o ARS-121L-DNR devem incluir métricas de eficiência energética por teraflop, latência interprocessos (NVLink) e throughput agregado de rede. Além disso, o monitoramento de disponibilidade e consumo térmico médio por nó fornece visibilidade sobre a maturidade operacional da infraestrutura. Empresas que substituem sistemas x86 tradicionais por plataformas Grace CPU Superchip relatam ganhos significativos em densidade de rack e redução

2U NVIDIA Grace Superchip: Desempenho Extremo para HPC e IA Empresarial Em um cenário empresarial marcado por demandas exponenciais de processamento, análise de dados e inteligência artificial, a escolha de infraestrutura computacional torna-se decisiva. O sistema 2U NVIDIA Grace Superchip emerge como uma solução de ponta, integrando CPUs Grace altamente eficientes e GPUs NVIDIA de última geração para atender workloads complexos em HPC, AI, treinamento de modelos de linguagem (LLM) e processamento de dados de alto desempenho. Introdução Contextualização Estratégica Organizações modernas enfrentam um crescimento acelerado de dados e necessidades de processamento paralelo. O gerenciamento eficiente desses recursos é essencial para competitividade. Sistemas convencionais muitas vezes apresentam gargalos em memória, interconectividade CPU-GPU e consumo energético. O 2U NVIDIA Grace Superchip aborda essas limitações, oferecendo uma arquitetura densa e otimizada para máxima eficiência de throughput e latência mínima. Desafios Críticos Os desafios incluem a execução de modelos de IA de larga escala, simulações científicas e workloads analíticos intensivos. Sistemas com CPUs tradicionais podem limitar o desempenho devido à largura de banda de memória restrita e baixa densidade de núcleos. Além disso, a interconectividade GPU-GPU e CPU-GPU é fundamental para acelerar cargas distribuídas, especialmente em ambientes que dependem de treinamentos de deep learning e inferência em tempo real. Custos e Riscos da Inação Ignorar a necessidade de infraestrutura otimizada pode resultar em atrasos críticos na entrega de projetos, aumento do custo total de propriedade e vulnerabilidades operacionais. A incapacidade de processar grandes volumes de dados com eficiência reduz a competitividade e compromete decisões estratégicas baseadas em insights analíticos. Sistemas subdimensionados podem levar a falhas em simulações complexas, degradação de performance de IA e restrições no desenvolvimento de LLMs. Visão Geral do Artigo Este artigo detalha os fundamentos técnicos do 2U NVIDIA Grace Superchip, suas vantagens estratégicas, considerações de implementação, práticas recomendadas, métricas de sucesso e implicações de negócios, fornecendo uma análise aprofundada para gestores de TI e engenheiros de infraestrutura. Desenvolvimento Problema Estratégico Empresas que dependem de computação intensiva enfrentam limitações significativas em termos de densidade de processamento, consumo energético e escalabilidade. Sistemas tradicionais não oferecem largura de banda suficiente entre CPU e GPU, nem suporte a memória de alta velocidade para workloads críticos. Isso impacta diretamente prazos de entrega, capacidade de análise e competitividade em setores que demandam inovação rápida, como AI, análise de dados e modelagem científica. Consequências da Inação Manter infraestruturas desatualizadas aumenta o risco de gargalos computacionais, falhas de processamento e atrasos em projetos de AI e HPC. A falta de memória rápida e de interconexão PCIe de última geração reduz eficiência energética e aumenta custos operacionais. Organizações podem experimentar atrasos no treinamento de LLMs, lentidão em simulações HPC e limitação de análise em tempo real, resultando em perda de oportunidades estratégicas. Fundamentos da Solução O 2U NVIDIA Grace Superchip integra CPU Grace de 144 núcleos com até 960GB de memória ECC LPDDR5X, garantindo baixa latência e alto desempenho por watt. Suporta até 2 GPUs NVIDIA H100 NVL ou L40S conectadas via PCIe 5.0 x16, permitindo interconectividade de alta velocidade entre CPU e GPU, bem como comunicação eficiente GPU-GPU. O sistema possui 4 bays NVMe E1.S hot-swap e slots M.2 PCIe 5.0 x4, oferecendo armazenamento ultra-rápido para workloads exigentes. A arquitetura 2U permite densidade elevada sem comprometer resfriamento ou redundância. Com até 3 fontes de 2000W Titanium Level (96% de eficiência), o sistema mantém confiabilidade energética e operação contínua em ambientes críticos. O design modular facilita upgrades de memória e GPUs, garantindo escalabilidade para atender demandas futuras. Implementação Estratégica A implementação requer alinhamento com objetivos de performance e eficiência energética. A seleção de GPUs (H100 NVL vs L40S) deve considerar workloads específicos de AI ou HPC. O gerenciamento do sistema pode ser realizado via IPMI 2.0, Redfish API ou Supermicro Update Manager, garantindo monitoramento detalhado de CPU, memória, temperatura e ventilação. Para integração eficiente, recomenda-se planejamento de conectividade PCIe e NVMe, além de testes de resfriamento para workloads máximos. Considerações de segurança incluem uso de TPM onboard, monitoramento contínuo via KVM-over-LAN e políticas de governança para manutenção de firmware atualizado e compliance. Melhores Práticas Avançadas Otimizações avançadas incluem balanceamento de workloads entre CPUs Grace e GPUs, priorização de memória ECC LPDDR5X para tarefas críticas e utilização de slots M.2 para cache de alta velocidade. Configurações de resfriamento devem ser ajustadas dinamicamente via controle de fan PWM, evitando hotspots e mantendo eficiência energética máxima. Para workloads de IA distribuída, a configuração PCIe e interconectividade GPU-GPU são cruciais. Técnicas de particionamento de memória e pipelines paralelos aumentam throughput sem comprometer integridade de dados. Ferramentas de monitoramento e alerta antecipado minimizam riscos de falha em produção. Medição de Sucesso Indicadores incluem desempenho por watt, latência de memória, throughput PCIe, tempo de treinamento de LLMs e eficiência de resfriamento. Métricas de confiabilidade abrangem uptime do sistema, falhas de ventiladores, consistência de temperatura e integridade de memória ECC. Avaliações periódicas permitem ajustes finos, garantindo alinhamento contínuo entre performance técnica e metas de negócio. Conclusão Resumo dos Pontos Principais O 2U NVIDIA Grace Superchip representa uma solução robusta para empresas que demandam HPC e AI de alta performance. Combina CPU Grace de 144 núcleos, memória ECC LPDDR5X de até 960GB, GPUs NVIDIA de ponta e armazenamento NVMe ultra-rápido, garantindo densidade, eficiência energética e escalabilidade. Considerações Finais Investir em infraestrutura de ponta reduz riscos de falhas, aumenta competitividade e permite exploração de workloads complexos, desde simulações HPC até treinamento de modelos de AI. A implementação estratégica, monitoramento contínuo e práticas avançadas de otimização são essenciais para extrair máximo valor do investimento. Perspectivas Futuras Com a evolução de LLMs e workloads distribuídos, a demanda por sistemas densos, eficientes e altamente interconectados continuará crescendo. O 2U NVIDIA Grace Superchip posiciona empresas para adoção de tecnologias emergentes, mantendo performance e eficiência energética. Próximos Passos Práticos Organizações devem realizar auditoria de workloads atuais, identificar gargalos em CPU-GPU e memória, planejar upgrades moduláveis e implementar monitoramento avançado para assegurar que o sistema opere com performance ideal. Considerar integração com soluções de AI e HPC distribuídas maximiza retorno sobre investimento.

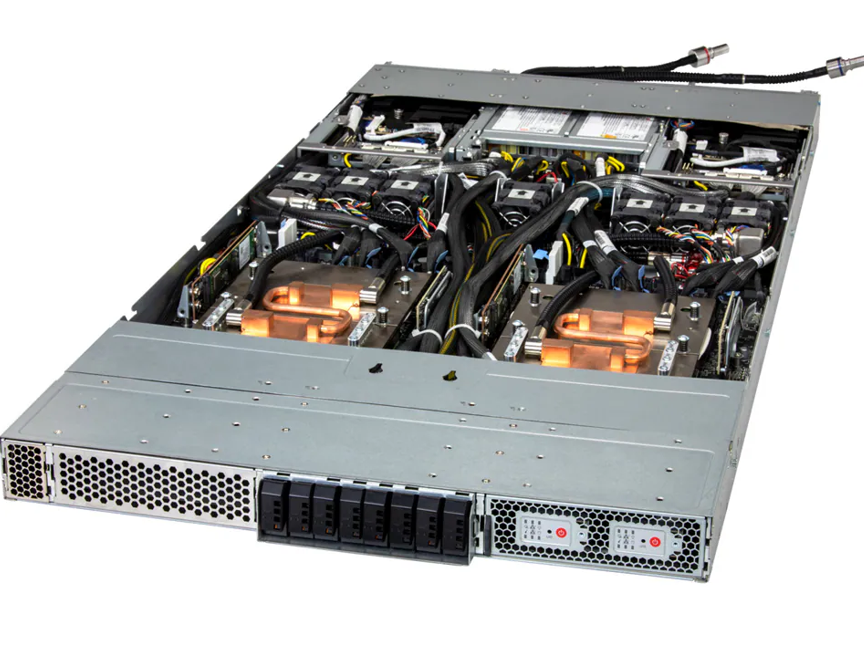

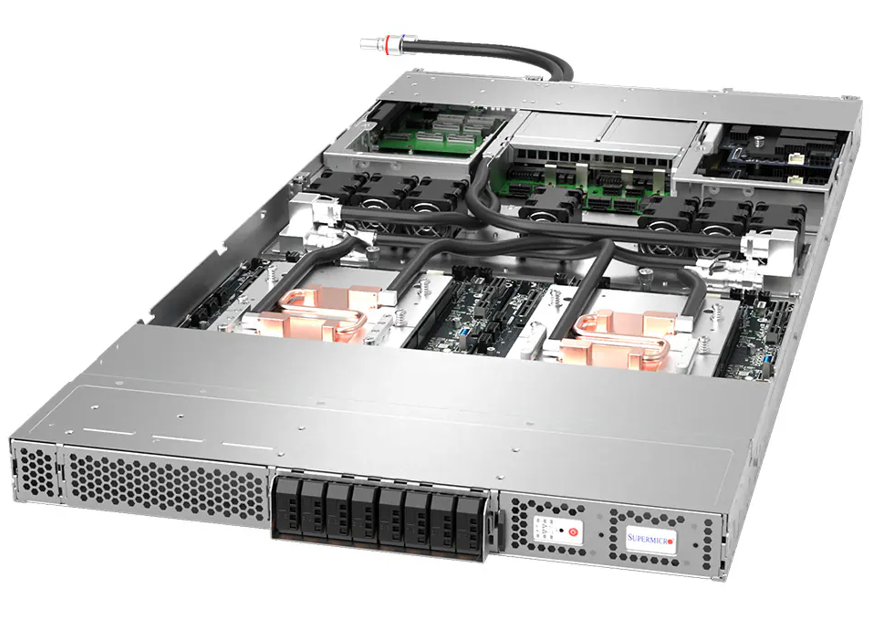

1U 2-Node NVIDIA GH200 Grace Hopper Superchip: Performance AI e HPC Avançada No cenário empresarial atual, a demanda por processamento de alto desempenho para Inteligência Artificial (AI), Machine Learning e Large Language Models (LLMs) cresce de forma exponencial. Organizações que não adotam sistemas otimizados para HPC (High Performance Computing) enfrentam limitações críticas de capacidade, escalabilidade e eficiência, impactando diretamente sua competitividade e tempo de entrega de insights estratégicos. O 1U 2-Node NVIDIA GH200 Grace Hopper Superchip surge como uma solução de vanguarda, oferecendo integração de CPU Grace e GPU H100, além de suporte para armazenamento E1.S de alta velocidade. Sua arquitetura compacta e líquida refrigerada permite densidade máxima sem comprometer performance ou confiabilidade. Este artigo explora profundamente os aspectos técnicos, estratégicos e operacionais do sistema, detalhando como ele resolve desafios críticos de infraestrutura, otimiza workloads de AI e HPC, e oferece retorno mensurável para empresas que dependem de alto desempenho computacional. Desafio Estratégico em HPC e AI Limitações de Infraestrutura Tradicional Servidores tradicionais de rack não conseguem sustentar workloads intensivos de AI e LLM devido à limitação de memória, largura de banda e densidade de GPU. A falta de integração estreita entre CPU e GPU aumenta a latência e reduz o throughput, impactando diretamente o desempenho de treinamento de modelos complexos e inferência em tempo real. Implicações para Negócios Organizações que não atualizam sua infraestrutura enfrentam aumento de custos operacionais, menor velocidade de inovação e risco de ficar atrás da concorrência em mercados que dependem de insights baseados em AI. Fundamentos da Solução: Arquitetura 1U 2-Node NVIDIA GH200 Integração Grace CPU + H100 GPU Cada nó do sistema conta com o Grace Hopper Superchip da NVIDIA, integrando CPU de 72 núcleos e GPU H100. Essa integração reduz latência de comunicação, melhora throughput em workloads HPC e AI, e possibilita execução simultânea de múltiplos pipelines de processamento sem comprometimento de performance. Memória e Armazenamento de Alta Performance O sistema suporta até 480GB de ECC LPDDR5X por nó, com GPU adicional de até 96GB ECC HBM3. O armazenamento E1.S NVMe em hot-swap oferece IOPS extremamente altos, essencial para treinamento de modelos de AI que manipulam grandes volumes de dados. Esta configuração reduz gargalos de I/O e melhora a eficiência energética, conectando diretamente performance técnica com redução de custos operacionais. Design Compacto e Refrigerado a Líquido O 1U 2-Node permite densidade sem comprometer o resfriamento. O sistema líquido refrigerado D2C (Direct to Chip) mantém TDPs de até 2000W por CPU, garantindo operação estável em workloads críticos. Além disso, o monitoramento de CPU, memória, ventoinhas e temperatura oferece governança e compliance operacional em data centers exigentes. Implementação Estratégica Considerações de Integração O sistema é altamente compatível com infraestruturas existentes em data centers, oferecendo slots PCIe 5.0 x16 para expansão adicional e conectividade com NVIDIA BlueField-3 ou ConnectX-7. Isso permite integração com redes de alta velocidade e soluções de armazenamento distribuído, mantendo interoperabilidade e escalabilidade. Gerenciamento e Monitoramento O BIOS AMI de 64MB e ferramentas de gerenciamento avançadas permitem configuração detalhada de ACPI, monitoramento de saúde do sistema e controle de ventoinhas via PWM, garantindo que cada componente opere dentro de parâmetros ideais. Essa abordagem reduz riscos operacionais e aumenta a confiabilidade. Melhores Práticas Avançadas Otimização de Workloads AI Para maximizar performance em treinamento de modelos, recomenda-se balancear cargas entre CPU e GPU, monitorar consumo de memória HBM3, e ajustar configuração de armazenamento E1.S NVMe para otimizar throughput. Estratégias de cooling e gerenciamento de energia devem ser implementadas para prevenir throttling em picos de demanda. Segurança e Governança O sistema permite segmentação de rede via BlueField-3, proporcionando isolamento de workloads críticos. Além disso, a redundância de fontes de 2700W Titanium garante continuidade operacional e segurança contra falhas elétricas, atendendo requisitos de compliance de data centers corporativos. Medição de Sucesso Métricas de Performance Indicadores-chave incluem throughput de treinamento de modelos AI, latência de inferência, utilização de memória LPDDR5X e HBM3, IOPS de armazenamento E1.S, e eficiência energética medida por performance por Watt. Monitoramento contínuo permite ajustes proativos e melhoria contínua. ROI e Impacto no Negócio Empresas que implementam o 1U 2-Node NVIDIA GH200 experimentam redução de tempo de treinamento de modelos, aceleração de pipelines de AI, maior densidade computacional e menor custo total de operação por unidade de processamento, conectando diretamente tecnologia a vantagem competitiva estratégica. Conclusão O 1U 2-Node NVIDIA GH200 Grace Hopper Superchip representa um avanço significativo para empresas que buscam alto desempenho em AI, Deep Learning e HPC. Sua arquitetura integrada, resfriamento líquido e suporte de memória/armazenamento de última geração resolvem desafios críticos de infraestrutura e performance. Ao adotar esta solução, organizações aumentam sua capacidade de inovação, reduzem riscos de operação e garantem competitividade em setores que dependem de processamento intensivo de dados. A implementação estratégica do sistema permite extração máxima de valor de cada componente, conectando performance técnica a resultados tangíveis de negócio. Com a evolução contínua de AI e HPC, o 1U 2-Node NVIDIA GH200 está posicionado como plataforma futura-proof, capaz de suportar demandas emergentes e expandir conforme necessidades corporativas crescem.

1U 2-Node NVIDIA GH200: Desempenho Máximo em HPC e IA Empresarial O avanço das demandas de High Performance Computing (HPC) e Inteligência Artificial (IA) exige soluções de hardware que combinem densidade, escalabilidade e eficiência energética. O sistema 1U 2-Node NVIDIA GH200 Grace Hopper Superchip surge como resposta a essa necessidade, oferecendo desempenho extremo em um espaço físico compacto, ideal para data centers corporativos que buscam maximizar capacidade computacional sem comprometer espaço ou eficiência. Introdução Contextualização Estratégica Empresas líderes em setores de pesquisa científica, finanças e modelagem preditiva estão cada vez mais dependentes de sistemas capazes de processar grandes volumes de dados em paralelo. A integração do NVIDIA GH200 Grace Hopper Superchip em um formato 1U de alta densidade permite que organizações aumentem significativamente a capacidade de processamento, mantendo operações de data center enxutas e controlando custos de energia e refrigeração. Desafios Críticos Os desafios técnicos incluem gerenciamento térmico, latência de comunicação entre CPU e GPU e integração com infraestrutura existente. Sem uma arquitetura otimizada, a performance de cargas de trabalho críticas de IA e LLM pode ser seriamente limitada, impactando prazos de entrega e eficiência operacional. Custos e Riscos da Inação A não atualização de sistemas para plataformas modernas como a 1U 2-Node NVIDIA GH200 pode resultar em custos elevados de oportunidade, maior consumo de energia, menor throughput em análise de dados e perda de competitividade frente a empresas que adotam soluções HPC avançadas. Visão Geral do Artigo Este artigo detalhará o desafio estratégico de alta densidade computacional, explorará as consequências da inação, apresentará os fundamentos técnicos do GH200, abordará a implementação estratégica e práticas avançadas, e finaliza com métricas de sucesso para avaliar a eficácia da solução. Desenvolvimento Problema Estratégico Organizações que dependem de processamento intensivo de IA enfrentam gargalos significativos em infraestrutura tradicional. A comunicação entre CPU e GPU é um fator crítico: latências elevadas podem degradar o desempenho em tarefas de treinamento de LLM ou inferência em deep learning. Soluções convencionais de 2U ou 4U podem ocupar mais espaço, aumentar consumo de energia e complicar a manutenção física do data center. Consequências da Inação Manter sistemas legados implica menor densidade de computação, maior consumo energético por operação e aumento do risco de falhas térmicas. Além disso, a incapacidade de processar workloads de IA em tempo real pode resultar em atrasos na entrega de insights estratégicos, afetando diretamente decisões de negócio e inovação. Fundamentos da Solução O 1U 2-Node NVIDIA GH200 combina dois nós em um único rack 1U, cada um equipado com: CPU NVIDIA Grace de 72 núcleos, integrando processamento de IA e gerenciamento de memória eficiente. GPU NVIDIA H100 Tensor Core, on-board, com interconexão NVLink Chip-2-Chip (C2C) de alta largura de banda (900GB/s) para comunicação ultra-rápida entre CPU e GPU. Memória onboard LPDDR5X de até 480GB ECC, mais até 96GB ECC HBM3 dedicada à GPU. Armazenamento direto E1.S NVMe, além de slots M.2 NVMe, permitindo I/O de altíssima performance. Essa arquitetura permite throughput elevado, baixa latência e maior eficiência energética, crucial para workloads de treinamento de deep learning e inferência em LLMs. Implementação Estratégica A implantação exige avaliação do layout físico do data center, garantindo fluxo de ar adequado e refrigeração eficiente, especialmente quando a opção de resfriamento direto ao chip (D2C) é utilizada. O gerenciamento de energia, com fontes redundantes Titanium 2700W, assegura continuidade operacional mesmo em cenários críticos. Integração com sistemas de rede existentes deve considerar compatibilidade com NVIDIA BlueField-3 ou ConnectX-7 para maximizar desempenho de interconexão e permitir virtualização de recursos de GPU quando necessário. Melhores Práticas Avançadas Para workloads distribuídos, recomenda-se balancear tarefas entre os dois nós para otimizar utilização da memória ECC e throughput NVLink. A monitoração constante via BIOS AMI e ferramentas de gerenciamento permite ajustes dinâmicos em ventoinhas, temperatura e consumo, prevenindo degradação de performance ou falhas térmicas. Além disso, o planejamento de expansão deve considerar slots PCIe 5.0 x16 FHFL e M.2 adicionais, garantindo escalabilidade sem comprometer densidade 1U. Medição de Sucesso Métricas críticas incluem: Throughput em operações de treinamento de IA (TFLOPS ou operações por segundo). Latência entre CPU e GPU via NVLink C2C. Eficiência energética medida em desempenho por watt. Taxa de utilização de memória ECC e HBM3. Disponibilidade e uptime do sistema com monitoramento contínuo de temperaturas e voltagens. Esses indicadores fornecem visão clara da performance operacional e retorno sobre investimento em ambientes empresariais de alta demanda. Conclusão Resumo dos Pontos Principais O 1U 2-Node NVIDIA GH200 oferece solução compacta, eficiente e de altíssimo desempenho para HPC, IA e LLM, integrando Grace CPU, H100 GPU, NVLink C2C e memória ECC avançada. Sua arquitetura aborda gargalos críticos de latência, densidade e escalabilidade. Considerações Finais Investir em plataformas de alta densidade como o GH200 é estratégico para organizações que buscam maximizar capacidade computacional, reduzir custos de energia e acelerar inovação em IA e deep learning. Perspectivas Futuras A evolução de arquiteturas 1U com integração CPU-GPU tende a se expandir, com maior densidade de memória, interconexões de mais alta largura de banda e suporte a workloads ainda mais complexos de IA e LLM. Próximos Passos Práticos Empresas devem avaliar suas demandas de processamento, planejar a infraestrutura de refrigeração e energia, e preparar a integração de rede e armazenamento para adotar sistemas 1U 2-Node GH200 de forma eficiente e segura.

Servidor 1U NVIDIA GH200 Grace Hopper: Alta performance em IA e HPC empresarial Introdução Em um cenário corporativo cada vez mais orientado por dados e inteligência artificial, a demanda por servidores de alta densidade e desempenho extremo tornou-se crítica. Organizações que buscam acelerar projetos de High Performance Computing (HPC) ou treinar modelos avançados de IA e LLMs enfrentam desafios significativos relacionados à latência, largura de banda de memória e consumo energético. A inação ou a adoção de soluções inadequadas pode resultar em atrasos de projeto, custos operacionais elevados e perda de competitividade em setores que dependem de análise avançada de dados. Neste contexto, o 1U GPU Server NVIDIA GH200 Grace Hopper surge como uma solução de ponta, oferecendo integração entre CPU e GPU com NVLink de alta largura de banda e memória coerente de até 576GB. Este artigo detalhará os principais desafios empresariais, fundamentos técnicos do servidor, estratégias de implementação e métricas de sucesso, oferecendo uma visão estratégica para empresas que buscam excelência em HPC e IA. Desenvolvimento Problema Estratégico O aumento exponencial de dados e a complexidade dos modelos de IA exigem servidores que combinem processamento massivo, baixa latência e alta largura de banda de memória. Servidores convencionais frequentemente sofrem gargalos entre CPU e GPU, limitando o desempenho em aplicações críticas como LLMs e treinamento de redes neurais profundas. Além disso, a densidade física dos data centers impõe restrições quanto a consumo de energia e gerenciamento térmico. O 1U padrão apresenta espaço limitado para dissipação de calor e armazenamento rápido, criando um desafio adicional para arquiteturas de alto desempenho. Consequências da Inação Ignorar essas necessidades pode levar a projetos de IA com tempos de treinamento prolongados, maior consumo energético e risco de falhas em workloads críticos. Empresas podem enfrentar atrasos em iniciativas estratégicas, perda de insights competitivos e custos operacionais elevados. A falta de integração eficiente entre CPU e GPU também limita a escalabilidade de aplicações corporativas de IA. Fundamentos da Solução O 1U GPU Server NVIDIA GH200 integra a CPU Grace e GPU H100 no mesmo chip, utilizando o NVLink Chip-to-Chip (C2C) com 900GB/s de largura de banda, reduzindo drasticamente a latência e maximizando a transferência de dados. A memória coerente de até 480GB LPDDR5X e 96GB HBM3 permite manipular grandes modelos de IA sem depender de memória adicional externa, crucial para treinamentos de LLM. O sistema ainda suporta drives E1.S NVMe diretamente conectados à CPU, garantindo armazenamento de alta velocidade com baixa latência, enquanto o resfriamento líquido D2C assegura estabilidade térmica mesmo em cargas extremas. Implementação Estratégica Para maximizar os benefícios deste servidor, recomenda-se configuração do sistema com monitoramento ativo de CPU, GPU e sensores de chassis via BMC, garantindo que as operações de HPC e IA permaneçam dentro das especificações térmicas e de consumo de energia. O gerenciamento de energia via ACPI permite recuperação automática após falhas de energia, essencial para operações críticas 24/7. A escolha de drives E1.S NVMe alinhados com workloads específicos, juntamente com otimização da memória LPDDR5X e HBM3, permite que empresas ajustem o desempenho segundo diferentes cenários de treinamento e inferência de modelos de IA. Melhores Práticas Avançadas 1. Planejamento térmico avançado: utilizar sensores de PWM e controle inteligente de ventiladores combinados com resfriamento líquido D2C para maximizar densidade computacional em 1U. 2. Gerenciamento de memória: balancear cargas entre LPDDR5X e HBM3 para reduzir latência em treinamento de LLM. 3. Otimização de interconexão: explorar NVLink C2C para cargas de trabalho híbridas CPU/GPU, garantindo throughput máximo e minimizando gargalos. Medição de Sucesso Indicadores críticos incluem tempo de treinamento de modelos de IA, throughput de dados entre CPU e GPU, utilização eficiente de memória e estabilidade térmica sob carga máxima. Métricas como consumo energético por operação, latência de interconexão e IOPS de armazenamento NVMe também devem ser monitoradas para validar o retorno do investimento. Conclusão O 1U GPU Server NVIDIA GH200 Grace Hopper representa uma solução estratégica para empresas que buscam alto desempenho em IA, LLM e HPC. Sua arquitetura integrada, memória coerente e resfriamento avançado permitem superar limitações de servidores tradicionais, oferecendo eficiência, escalabilidade e confiabilidade. Ao adotar esta solução, organizações podem reduzir tempos de treinamento de IA, aumentar a densidade computacional em racks 1U e minimizar riscos operacionais. A implementação cuidadosa de monitoramento, otimização de memória e gerenciamento térmico assegura que a tecnologia entregue todo seu potencial estratégico. Perspectivas futuras incluem a expansão da integração de CPU-GPU em chips únicos e evolução de tecnologias de memória de alta largura de banda, permitindo que empresas mantenham vantagem competitiva em workloads críticos.

Introdução Em um cenário empresarial cada vez mais orientado por inteligência artificial, aprendizado de máquina e grandes modelos de linguagem (LLMs), a necessidade de infraestrutura de computação de alto desempenho é crítica. Organizações enfrentam desafios de escalabilidade, latência e complexidade de integração que impactam diretamente a velocidade de inovação e a competitividade no mercado. A adoção inadequada ou a ausência de sistemas especializados para cargas de trabalho intensivas de IA e HPC pode resultar em custos operacionais elevados, desperdício de recursos e atrasos significativos em projetos estratégicos. Além disso, problemas de interoperabilidade entre CPU e GPU ou limitações de memória podem comprometer modelos avançados de inferência e treinamento. Este artigo oferece uma análise detalhada do Supermicro 2U GPU GH200 Grace Hopper Superchip System, destacando arquitetura, desempenho, interconectividade e implicações estratégicas para organizações que buscam excelência em inteligência artificial, HPC e LLMs. Problema Estratégico Empresas que executam projetos de inteligência artificial e HPC enfrentam um dilema crítico: como conciliar densidade computacional, eficiência energética e latência mínima em um único sistema. A complexidade aumenta com modelos generativos que demandam largura de banda de memória extremamente alta e coerência entre CPU e GPU. Soluções tradicionais de múltiplos servidores ou GPU separadas não conseguem oferecer a interconectividade necessária para LLMs de próxima geração. A limitação de memória e a baixa taxa de transferência entre CPU e GPU tornam o treinamento e a inferência mais lentos, elevando custos e reduzindo competitividade. Consequências da Inação Ignorar a necessidade de um sistema integrado como o GH200 implica riscos significativos: atrasos no desenvolvimento de produtos de IA, consumo excessivo de energia e maior complexidade operacional. Além disso, a falta de recursos avançados de interconexão e memória coerente pode limitar a escalabilidade de modelos generativos, impactando diretamente a capacidade de inovação da organização. Fundamentos da Solução O Supermicro 2U GPU GH200 oferece uma arquitetura unificada que combina dois GPUs NVIDIA H100 com dois CPUs Arm Neoverse V2 de 72 núcleos em cada GH200 Grace Hopper Superchip. A integração do NVLink Chip-to-Chip (C2C) permite comunicação de alta largura de banda (900GB/s) entre CPU e GPU, crucial para cargas de trabalho intensivas de IA e HPC. O sistema suporta até 1248GB de memória coerente, distribuídos entre 960GB de LPDDR5X e 288GB de HBM3e nos GPUs, oferecendo recursos para manipulação de grandes modelos de linguagem sem gargalos. Essa configuração garante que operações de treinamento e inferência ocorram com máxima eficiência e mínima latência. O design inclui 4 slots PCIe 5.0 x16, permitindo integração de NVIDIA BlueField-3 e ConnectX-7 para aceleração de rede e armazenamento remoto, ampliando ainda mais a capacidade de processamento distribuído e de edge AI. Implementação Estratégica A implementação exige consideração detalhada de resfriamento, energia e integração com software de gerenciamento de data center. O sistema vem equipado com até 6 ventiladores de alta performance com controle opcional de velocidade, garantindo estabilidade térmica mesmo sob cargas máximas. Quatro fontes redundantes de 2000W em nível Titanium proporcionam resiliência energética, minimizando riscos de downtime em operações críticas. A compatibilidade com sistemas de monitoramento de CPU, memória e ventoinhas via BMC permite gestão proativa e alinhamento com políticas de governança e compliance. Melhores Práticas Avançadas Para maximizar desempenho, recomenda-se alocar modelos LLM em memória HBM3e sempre que possível, enquanto a LPDDR5X gerencia tarefas auxiliares. A utilização de NVLink para comunicação CPU-GPU e GPU-GPU reduz latência, permitindo treinamento de modelos generativos em escala de produção. Integração com aceleradores de rede BlueField-3 permite offload de tarefas de I/O e segurança, liberando ciclos de GPU para processamento direto de IA. Estratégias de balanceamento de carga e gestão de energia devem ser implementadas para otimizar operação contínua e evitar throttling térmico. Medição de Sucesso Indicadores chave incluem throughput de treinamento de modelos LLM (tokens por segundo), latência de inferência, utilização de memória coerente e eficiência energética. Monitoramento contínuo do NVLink, ventoinhas e consumo de energia garante que o sistema opere dentro dos parâmetros ideais e fornece dados para ajustes de escalabilidade. Conclusão O Supermicro 2U GPU GH200 Grace Hopper Superchip System representa uma solução de ponta para organizações que buscam desempenho extremo em IA, LLMs e HPC. Sua arquitetura unificada, memória coerente e interconectividade NVLink oferecem vantagens significativas sobre soluções tradicionais de múltiplos servidores. A adoção estratégica desse sistema reduz riscos operacionais, melhora a eficiência energética e maximiza a velocidade de desenvolvimento de aplicações de inteligência artificial. Organizações podem expandir suas capacidades de processamento de forma segura e escalável, mantendo competitividade em mercados de rápida evolução. Perspectivas futuras incluem integração com tecnologias emergentes de interconexão e gerenciamento automatizado de workloads de IA, garantindo evolução contínua da infraestrutura de HPC e AI empresarial. Próximos passos práticos envolvem planejamento de data center, configuração de resfriamento e energia, integração com software de gerenciamento e treinamento de equipes para operação otimizada, garantindo que a implementação do GH200 traga resultados estratégicos mensuráveis.

Introdução Em um cenário corporativo cada vez mais orientado por inteligência artificial, análise avançada de dados e computação de alto desempenho (HPC), a escolha da infraestrutura correta é um diferencial estratégico. O UP Intel 2U PCIe GPU System surge como uma solução projetada para atender às demandas críticas de organizações que dependem de processamento intensivo, garantindo performance, escalabilidade e confiabilidade. As empresas que operam em setores como pesquisa científica, modelagem de dados complexos e laboratórios de desenvolvimento enfrentam desafios significativos na implementação de sistemas capazes de suportar GPUs de última geração e memória de alta velocidade. Falhas em desempenho ou limitações de expansão podem gerar atrasos em projetos, aumentar custos operacionais e comprometer competitividade. Este artigo explora detalhadamente os fundamentos, arquitetura, recursos e práticas de implementação do UP Intel 2U PCIe GPU System, destacando sua relevância estratégica, implicações técnicas e benefícios concretos para o ambiente empresarial moderno. Problema Estratégico Desafios de Computação Intensiva Organizações que realizam modelagem de dados, simulações científicas ou treinamento de modelos de IA dependem de sistemas capazes de processar grandes volumes de informação de forma eficiente. Sistemas tradicionais frequentemente apresentam limitações em largura de banda PCIe, capacidade de memória e escalabilidade de GPU, gerando gargalos críticos. O UP Intel 2U PCIe GPU System foi desenvolvido para eliminar estes gargalos, oferecendo suporte a até quatro GPUs de duplo slot, interconectadas via PCIe 5.0 x16, garantindo comunicação de alta velocidade entre CPU e aceleradores. Esta arquitetura é crucial para reduzir latências em cargas de trabalho paralelas e complexas, mantendo throughput consistente mesmo em operações intensivas. Consequências da Inação Negligenciar a atualização da infraestrutura ou optar por sistemas subdimensionados pode acarretar atrasos em projetos de pesquisa, perdas de eficiência em modelagem de dados e falhas no cumprimento de SLAs em ambientes de produção crítica. Além disso, limitações de expansão de memória e GPU reduzem a capacidade de processamento futuro, tornando a organização menos competitiva frente à inovação tecnológica. Fundamentos da Solução Arquitetura do Sistema O UP Intel 2U PCIe GPU System apresenta uma arquitetura cuidadosamente projetada para maximizar desempenho e confiabilidade. Seu processador Intel® Xeon® 6700 series, single socket, suporta até 80 núcleos e 160 threads, com TDP de até 350W, oferecendo base sólida para operações de HPC. O suporte a até 2TB de memória ECC DDR5 em 16 slots DIMM garante integridade de dados e alta capacidade de processamento paralelo. O sistema oferece quatro slots PCIe 5.0 x16 FHFL de duplo slot para GPUs e três slots adicionais PCIe 5.0 x16, possibilitando flexibilidade para configurações híbridas. A interconexão CPU-GPU via PCIe 5.0 e GPU-GPU via NVIDIA NVLink (opcional) proporciona baixa latência e alta largura de banda para cargas de trabalho distribuídas. Armazenamento e Confiabilidade Com quatro baias frontais hot-swap E1.S NVMe e suporte a duas unidades M.2 PCIe 5.0 x2, o sistema permite configurações de armazenamento ultra-rápidas, essenciais para datasets de IA e HPC. Três fontes redundantes Titanium Level de 2000W asseguram continuidade operacional, minimizando riscos de downtime por falha de energia. Segurança e Gestão Avançada O sistema incorpora Trusted Platform Module (TPM) 2.0, Silicon Root of Trust e funcionalidades de Secure Boot, garantindo proteção contra comprometimentos de firmware e ataques de supply chain. O software de gestão, incluindo SuperCloud Composer® e Supermicro Server Manager, permite monitoramento e automação avançados, otimizando operação e manutenção. Implementação Estratégica Planejamento de Capacidade A implementação deve considerar não apenas as necessidades atuais, mas também a escalabilidade futura. Avaliar requisitos de GPU, memória e armazenamento ajuda a evitar sobrecargas e gargalos, garantindo que o investimento suporte crescimento em IA, deep learning e HPC. Configuração de GPUs e Memória Para workloads de treinamento de IA, recomenda-se configurar GPUs com NVLink, explorando a largura de banda máxima entre aceleradores. A memória ECC DDR5 deve ser distribuída estrategicamente nos canais para otimizar throughput e reduzir latência de acesso. O planejamento cuidadoso desses recursos impacta diretamente no desempenho e confiabilidade do sistema. Integração com Infraestrutura Existente O UP Intel 2U PCIe GPU System integra-se facilmente a racks padrão de 2U, conectividade 1GbE dedicada e sistemas de armazenamento em rede. Considerar compatibilidade com software de orquestração, clusters de GPU e soluções de virtualização garante operação eficiente e interoperabilidade com ambientes corporativos complexos. Melhores Práticas Avançadas Otimização de Resfriamento e Eficiência Energética O sistema inclui até seis ventoinhas de 6cm com controle de velocidade otimizado e air shroud, mantendo temperaturas ideais mesmo sob carga máxima. Monitoramento ativo de temperatura e ajustes automáticos de PWM asseguram eficiência energética e longevidade dos componentes críticos. Monitoramento e Prevenção de Falhas Ferramentas de diagnóstico, como Super Diagnostics Offline (SDO), aliadas ao monitoramento contínuo de CPU, memória e ventiladores, permitem identificar e mitigar falhas antes que impactem operações críticas. Estratégias de redundância de fonte e hot-swap NVMe reduzem riscos de downtime. Medição de Sucesso O sucesso da implementação é mensurável por métricas de throughput de GPU, utilização de memória, latência de interconexão e disponibilidade operacional. Indicadores de desempenho, combinados com monitoramento proativo de integridade de hardware, fornecem visão precisa sobre eficiência do sistema e retorno sobre investimento. Conclusão O UP Intel 2U PCIe GPU System representa uma solução completa para organizações que demandam alta performance em IA, deep learning e HPC. Sua arquitetura robusta, conectividade avançada, armazenamento rápido e recursos de segurança oferecem confiabilidade e escalabilidade para desafios empresariais críticos. A adoção estratégica desse sistema permite que empresas se mantenham competitivas em ambientes de alto processamento de dados, reduzindo riscos operacionais e garantindo suporte a projetos complexos de pesquisa e desenvolvimento. Perspectivas futuras incluem expansão em workloads de IA generativa e HPC híbrido, onde a flexibilidade do UP Intel 2U PCIe GPU System continuará a oferecer vantagem competitiva e suporte à inovação tecnológica.

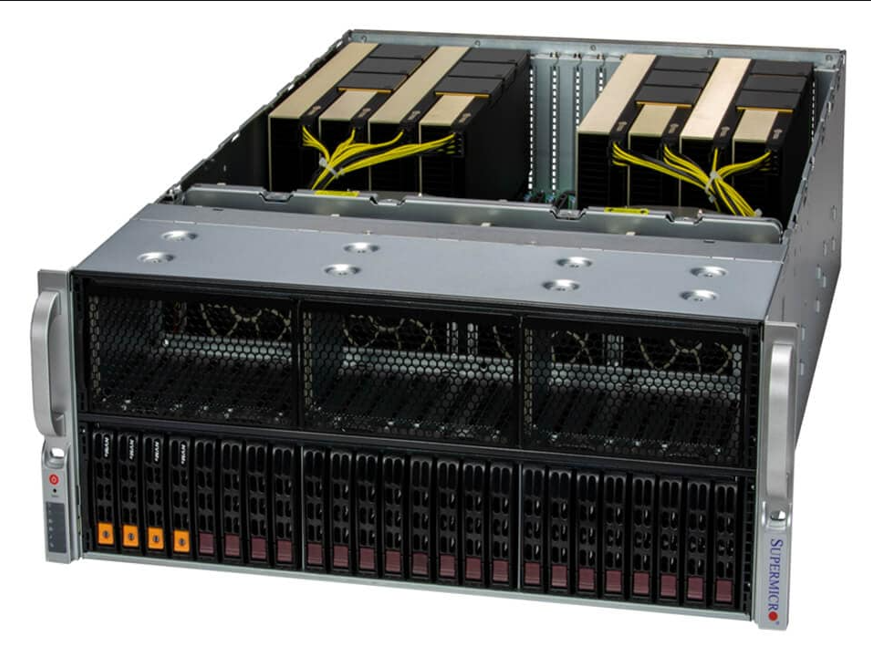

SuperServer 4U Dual-Root PCIe: Desempenho Máximo em HPC e IA O SuperServer 4U Dual-Root PCIe representa uma solução de ponta para organizações que demandam alto desempenho computacional em ambientes de High Performance Computing (HPC), IA/Deep Learning, automação industrial, análise de dados e modelagem financeira. Com suporte para até 8 GPUs de 600W, memória DDR5 ECC de alta velocidade e armazenamento NVMe ultrarrápido, este sistema oferece uma infraestrutura robusta para cargas críticas, garantindo performance, escalabilidade e confiabilidade. Introdução: Contextualização Estratégica No cenário atual, empresas e centros de pesquisa enfrentam uma pressão crescente para processar volumes massivos de dados em tempo reduzido. Áreas como inteligência artificial, análise de grandes bases de dados e simulações complexas dependem de soluções de computação que combinem alta capacidade de processamento, interconectividade eficiente entre CPU e GPU e armazenamento de baixa latência. A escolha de servidores que atendam a esses requisitos é estratégica, pois impacta diretamente no tempo de entrega de projetos, custo operacional e vantagem competitiva. Um desafio crítico é a integração de múltiplas GPUs de alto consumo energético sem comprometer a estabilidade do sistema ou a performance do barramento PCIe. A implementação inadequada pode resultar em throttling, gargalos de comunicação entre CPU e GPU e indisponibilidade para workloads sensíveis a tempo de execução, como treinamento de modelos de IA e processamento financeiro em tempo real. O SuperServer SYS-422GL-NR da Supermicro aborda esses desafios por meio de arquitetura Dual-Root PCIe, suporte a até 8 GPUs de 600W e interconexão NVIDIA NVLink opcional, garantindo throughput elevado e escalabilidade para workloads críticos. Problema Estratégico: Desafios de HPC e IA em Infraestruturas Tradicionais Capacidade de Processamento Limitada Servidores convencionais muitas vezes não suportam múltiplas GPUs de alta potência, limitando a capacidade de treinamento de modelos complexos de IA. Isso impacta diretamente prazos de projeto e qualidade das análises, pois o paralelismo massivo necessário não pode ser plenamente explorado. Gargalos de Interconexão Em sistemas tradicionais, a comunicação entre CPU e GPU pode se tornar um gargalo crítico. O SuperServer utiliza arquitetura Dual-Root PCIe 5.0 x16 para cada CPU, permitindo máxima largura de banda dedicada às GPUs e reduzindo latência de comunicação, essencial para operações de deep learning distribuído e simulações financeiras em tempo real. Limitações de Memória e Armazenamento Workloads intensivos em dados exigem memória de alta capacidade e consistência de erros (ECC) para prevenir falhas críticas. Este servidor suporta até 24 DIMMs DDR5 ECC de até 6400 MT/s (ou 8800 MT/s MRDIMM), totalizando até 6TB por CPU, além de até 8 NVMe E1.S hot-swap de alta velocidade, permitindo armazenamento rápido para datasets massivos. Consequências da Inação: Custos e Riscos A escolha de servidores inadequados para HPC ou IA pode gerar impactos severos: Perda de competitividade: lentidão em treinamento de modelos de IA ou análise de dados frente a concorrentes com infraestrutura otimizada. Custos operacionais elevados: maior consumo energético devido a sistemas menos eficientes e maior tempo de processamento. Riscos de falha: memória não ECC ou barramentos insuficientes podem gerar erros silenciosos em cálculos críticos. Escalabilidade limitada: dificuldade de expandir capacidade GPU ou memória sem substituição de toda a plataforma. Fundamentos da Solução: Arquitetura e Recursos Técnicos CPU Dual Socket Intel Xeon 6900 O sistema utiliza dois processadores Intel Xeon série 6900 com P-cores de até 500W, permitindo 72 núcleos e 144 threads combinadas. Essa configuração garante processamento paralelo massivo e suporte a interconexão de alta largura de banda com GPUs, essencial para operações de HPC e IA. O suporte a TDP elevado permite utilizar CPUs de ponta sem throttling, garantindo estabilidade mesmo sob carga máxima. GPU e Interconexão Até 8 GPUs de 600W podem ser instaladas, incluindo NVIDIA H100 NVL, H200 NVL (141GB) e RTX PRO 6000 Blackwell. Para cargas de IA distribuídas, o uso opcional de NVIDIA NVLink entre GPUs reduz latência de comunicação, permitindo treinamento de modelos com datasets enormes e complexos sem gargalos. A arquitetura Dual-Root PCIe 5.0 x16 oferece caminhos dedicados para GPUs, evitando saturação do barramento. Memória e Armazenamento O servidor suporta até 24 DIMMs DDR5 ECC RDIMM ou MRDIMM, com taxas de até 6400/8800 MT/s, permitindo consistência e alta performance. O armazenamento inclui até 8 E1.S NVMe hot-swap na frente, além de slots M.2 PCIe 4.0, garantindo flexibilidade para configuração de datasets locais e cache de alto desempenho. A memória ECC protege contra erros silenciosos, crucial para aplicações científicas e financeiras. Redundância e Segurança Quatro fontes redundantes de 3200W (configuração 3+1) nível Titanium garantem operação contínua, mesmo em caso de falha de uma unidade. Segurança é reforçada por TPM 2.0, Silicon Root of Trust (NIST 800-193) e firmware assinado, assegurando integridade do sistema, proteção de dados e compliance em ambientes regulados. Implementação Estratégica: Otimizando HPC e IA Configuração Modular O SuperServer permite flexibilidade de expansão via slots PCIe adicionais e hot-swap NVMe, facilitando upgrades sem downtime. Estratégias de balanceamento de carga entre CPUs e GPUs maximizam utilização de recursos, essencial para treinamento paralelo em IA ou simulações financeiras de alta complexidade. Gerenciamento Avançado Ferramentas como SuperCloud Composer, Supermicro Server Manager e Thin-Agent Service permitem monitoramento, provisionamento e automação, reduzindo esforço operacional e aumentando confiabilidade em centros de dados críticos. Recursos de diagnóstico offline permitem identificar falhas antes que impactem workloads. Melhores Práticas Avançadas Otimização de GPU e CPU Para workloads distribuídos, utilize NVLink entre GPUs quando disponível e configure perfis de energia das CPUs para maximizar throughput sem comprometer estabilidade. Monitoramento contínuo de TDP e temperatura dos componentes é essencial para prevenir throttling em cargas prolongadas. Gestão de Memória e Armazenamento Use configurações balanceadas de memória (1DPC vs 2DPC) conforme a necessidade de performance vs capacidade. Armazenamento NVMe deve ser configurado com RAID ou software-defined storage para garantir redundância e throughput adequado, especialmente em análises financeiras ou simulações científicas que exigem latência mínima. Segurança e Compliance Implemente Secure Boot, criptografia de firmware e monitoramento de supply chain. A integração de TPM 2.0 com políticas corporativas garante compliance em ambientes regulados, como finanças, saúde e pesquisa farmacêutica. Medição de Sucesso Métricas essenciais incluem: Utilização de CPU/GPU (%) em workloads críticos Throughput de memória

Introdução O SuperServer SYS-421GE-TNRT3 representa uma solução de computação de alto desempenho em arquitetura 4U, projetada para atender às demandas críticas de data centers modernos, inteligência artificial, treinamento de deep learning e aplicações de visualização 3D e streaming de mídia. No cenário empresarial atual, a necessidade de infraestrutura que combine flexibilidade de GPU, alta densidade de memória e confiabilidade operacional é cada vez mais estratégica, permitindo que organizações obtenham vantagem competitiva em processos de análise, renderização e processamento massivo de dados. Organizações enfrentam desafios críticos ao lidar com workloads intensivos: a complexidade na integração de múltiplas GPUs, limitações de throughput de memória, risco de downtime em operações contínuas e necessidade de escalabilidade em ambientes híbridos e on-premises. A inação ou a escolha de servidores inadequados pode resultar em gargalos de processamento, atrasos em projetos estratégicos e aumento de custos operacionais. Este artigo explora detalhadamente o design, capacidades técnicas e estratégias de implementação do SuperServer SYS-421GE-TNRT3, demonstrando como sua arquitetura permite desempenho máximo, confiabilidade e compatibilidade com tecnologias emergentes. Problema Estratégico Desafios de Computação Intensiva em Empresas Empresas que executam workloads de HPC, IA ou streaming enfrentam desafios de latência e throughput quando servidores tradicionais não conseguem interconectar múltiplas GPUs de forma eficiente. O processamento paralelo massivo exige interconexão direta entre CPU e GPU, além de suporte a memória de alta largura de banda para evitar gargalos. Sem isso, há impacto direto na produtividade, capacidade analítica e qualidade de serviço. Integração e Gerenciamento Complexo Outro desafio crítico é a interoperabilidade de hardware em racks densos. A manutenção de redundância, monitoramento de temperatura, fornecimento de energia confiável e compatibilidade com padrões como NVLink e PCIe Gen 5.0 são fatores que determinam a eficácia operacional. A falha em prever essas necessidades resulta em downtime e custos adicionais com suporte e substituição de componentes. Consequências da Inação Ignorar a complexidade da infraestrutura necessária para GPUs de alta performance implica riscos financeiros e estratégicos. Custos de ineficiência energética, falhas de hardware devido a gerenciamento inadequado de temperatura, e limitações na expansão futura podem comprometer projetos críticos de IA, análise de dados e renderização de conteúdo digital. Além disso, a falta de compliance com padrões de segurança e governança, como TPM 2.0 e Silicon Root of Trust, pode expor dados sensíveis a vulnerabilidades e dificultar certificações essenciais para operações corporativas seguras. Fundamentos da Solução Arquitetura de CPU e Memória O SYS-421GE-TNRT3 suporta processadores Intel Xeon de 4ª e 5ª geração, com até 64 núcleos e 128 threads por CPU, permitindo até 320 MB de cache. A memória DDR5 ECC oferece até 8 TB distribuídos em 32 slots DIMM, garantindo alta largura de banda e correção de erros crítica para workloads sensíveis. Integração de GPUs e Interconectividade O servidor oferece até 8 GPUs de largura dupla ou simples, incluindo modelos NVIDIA H100 NVL, RTX A4000 e A100. A interconexão PCIe 5.0 x16 entre CPU e GPU maximiza o throughput, enquanto a ponte NVIDIA NVLink opcional permite comunicação direta entre GPUs, reduzindo latência e aumentando eficiência em treinamentos de IA e simulações complexas. Armazenamento e Expansão A configuração padrão inclui 4 bays hot-swap NVMe de 2.5” e 8 bays hot-swap SATA, possibilitando hierarquias de armazenamento otimizadas para velocidade e capacidade. O suporte a M.2 NVMe adicional permite aceleração de caches ou armazenamento primário de dados críticos. Confiabilidade e Redundância O design de energia conta com quatro fontes redundantes de 2700W Titanium, garantindo tolerância a falhas e continuidade de operação. Os oito ventiladores heavy-duty com controle de velocidade garantem resfriamento eficiente, e o chassis 4U proporciona compatibilidade com racks padrão, mantendo a densidade de hardware sem comprometer a dissipação térmica. Implementação Estratégica Integração em Data Centers Existentes Ao planejar a implementação, é essencial avaliar requisitos de energia, refrigeração e rack space. O monitoramento de temperatura e velocidade dos ventiladores, aliado a recursos de BIOS AMI e software de gestão Supermicro Server Manager, permite ajustes finos para operação contínua sem risco de sobreaquecimento ou throttling de CPU/GPU. Segurança e Compliance O TPM 2.0 e Silicon Root of Trust proporcionam segurança de firmware e proteção contra ataques de cadeia de suprimentos. Funções como Secure Boot, firmware assinado criptograficamente e recuperação automática de firmware são fundamentais para ambientes regulados e operações críticas. Melhores Práticas Avançadas Otimização de GPU e Memória Configurações de memória dual-DPC com ECC DDR5 permitem máxima densidade sem comprometer estabilidade. A interconexão NVLink entre GPUs deve ser considerada para workloads que dependem de comunicação intensa entre unidades de processamento gráfico, como deep learning distribuído e simulações científicas. Gerenciamento de Energia e Térmico Ajustes finos de controle de ventiladores e monitoramento de tensão das fases de CPU garantem operação eficiente e prevenção de falhas. Estratégias de distribuição de carga entre fontes redundantes minimizam riscos em operações contínuas de missão crítica. Medição de Sucesso Indicadores de desempenho incluem utilização de GPU e CPU, throughput de memória, IOPS de armazenamento NVMe, temperatura média do chassis e taxa de falhas de hardware. Métricas de eficiência energética, como consumo por operação de GPU, também são essenciais para avaliação de ROI e escalabilidade em data centers. Conclusão O SuperServer SYS-421GE-TNRT3 consolida-se como uma solução estratégica para empresas que demandam alta performance, confiabilidade e flexibilidade em ambientes de HPC, IA e visualização digital. Sua arquitetura 4U com suporte a até 8 GPUs, memória DDR5 de 8TB e fontes redundantes Titanium garante que operações críticas possam ser executadas com segurança, eficiência e escalabilidade. Implementar este servidor requer planejamento cuidadoso de energia, refrigeração e interconexão de GPU para extrair o máximo desempenho. Com métricas bem definidas e monitoramento contínuo, organizações podem alcançar alto nível de operação e confiabilidade, enquanto se preparam para evoluções futuras em processamento paralelo e inteligência artificial. O investimento em infraestrutura como o SYS-421GE-TNRT3 transforma a capacidade de execução de workloads complexos, permitindo que equipes técnicas e de negócio obtenham insights mais rápidos, soluções de IA mais eficientes e operações de data center robustas e seguras.

Introdução Em ambientes corporativos de alta performance, a necessidade por servidores capazes de suportar cargas massivas de computação é crítica. O Supermicro GPU SuperServer SYS-421GE-TNRT representa uma solução de ponta para organizações que buscam acelerar processos de inteligência artificial, deep learning, visualização 3D e streaming de mídia em larga escala. O desafio central das empresas que operam com grandes volumes de dados e aplicações complexas é equilibrar capacidade computacional, escalabilidade e eficiência energética. Servidores tradicionais frequentemente se tornam gargalos, limitando o potencial de análise de dados em tempo real e comprometendo prazos estratégicos. Não investir em infraestrutura de GPU adequada pode acarretar custos elevados, como atraso em pesquisas, redução de produtividade em renderização e simulações, além de riscos operacionais em ambientes críticos de missão. Este artigo detalha o Supermicro SYS-421GE-TNRT, explorando sua arquitetura, capacidades, integração e aplicação prática no cenário empresarial. Desenvolvimento Problema Estratégico Organizações que dependem de processamento paralelo intenso, como centros de pesquisa, estúdios de animação ou provedores de serviços de nuvem, enfrentam desafios de latência, throughput e capacidade de expansão. Servidores convencionais muitas vezes não suportam múltiplas GPUs de alto desempenho simultaneamente, limitando tarefas de IA, modelagem 3D e streaming em tempo real. O SYS-421GE-TNRT aborda esse problema com suporte a até 10 GPUs NVIDIA de última geração, interconectadas via PCIe 5.0 dual-root e com suporte opcional a NVIDIA NVLink, garantindo alta largura de banda entre GPUs e máxima eficiência computacional para workloads críticos. Consequências da Inação Empresas que não atualizam sua infraestrutura para suportar estas cargas de trabalho enfrentam riscos significativos. Isso inclui tempo de processamento prolongado, gargalos em pipelines de deep learning, aumento de custo operacional por ineficiência energética e limitações em serviços críticos que dependem de computação acelerada. Além disso, a falta de redundância adequada, monitoramento de hardware e gerenciamento avançado pode levar a falhas inesperadas, resultando em interrupções de serviço e perda de dados valiosos. Fundamentos da Solução O Supermicro SYS-421GE-TNRT combina arquitetura de ponta com componentes otimizados para alta densidade de processamento. O servidor suporta processadores Intel Xeon de 4ª e 5ª geração, com até 64 núcleos por CPU e 320MB de cache, oferecendo base robusta para operações intensivas de CPU e GPU. Com 32 slots DIMM e capacidade de até 8TB de DDR5 ECC, o sistema garante ampla memória para operações simultâneas em deep learning e simulação científica. O design dual-root PCIe 5.0 permite que todas as GPUs mantenham comunicação de alta velocidade, enquanto a opção de bridges NVLink/Intel Xe Link potencializa ainda mais o throughput em aplicações multi-GPU. O chassis 4U com até 8 hot-swap drives 2.5” NVMe/SATA e dois slots M.2 NVMe oferece flexibilidade de armazenamento de alto desempenho, essencial para cargas de trabalho com datasets massivos. O monitoramento de hardware e controle de ventoinhas otimizam eficiência térmica, crucial para operações contínuas em data centers. Implementação Estratégica A implementação exige planejamento detalhado de layout de rack, fornecimento de energia redundante e integração com a rede corporativa. Cada servidor utiliza 4 fontes redundantes de 2700W, garantindo operação contínua mesmo em falhas parciais. O gerenciamento é facilitado por SuperCloud Composer, Supermicro Server Manager e SuperDoctor 5, permitindo monitoramento em tempo real e automação de processos. Além disso, o uso de TPM 2.0 e Silicon Root of Trust garante segurança física e lógica do servidor, protegendo contra ameaças cibernéticas e falhas de firmware. A integração com sistemas existentes deve considerar compatibilidade de drivers, conectividade 10GbE e requisitos de resfriamento para manter performance otimizada. Melhores Práticas Avançadas Para maximizar o retorno sobre o investimento, recomenda-se balancear carga de trabalho entre CPUs e GPUs, utilizar armazenamento NVMe para datasets críticos, aplicar estratégias de resfriamento ativo e monitorar consumo energético. A utilização de bridges NVLink entre GPUs é indicada para workloads que exigem alta interdependência de processamento. Implementar políticas de atualização de firmware criptograficamente assinadas e monitoramento de sensores de temperatura previne falhas inesperadas e garante conformidade com normas corporativas de segurança. Medição de Sucesso Indicadores chave incluem: throughput de processamento de IA, tempo de renderização 3D, latência em streaming, taxa de utilização de GPU/CPU, eficiência energética e disponibilidade do sistema. O monitoramento contínuo permite ajustes estratégicos e identificação de gargalos antes que impactem operações críticas. Conclusão O Supermicro GPU SuperServer SYS-421GE-TNRT oferece uma plataforma confiável e escalável para organizações que demandam processamento intenso e alta densidade de GPUs. Sua arquitetura dual-root PCIe 5.0, suporte a até 10 GPUs NVIDIA, memória de até 8TB e recursos avançados de segurança garantem performance, confiabilidade e eficiência operacional. Empresas que adotam esta solução mitigam riscos de ineficiência, aceleram ciclos de pesquisa e desenvolvimento e elevam o desempenho em aplicações críticas de IA, deep learning, simulação e streaming. A evolução contínua de workloads exigirá atenção à escalabilidade, integração de novas GPUs e otimizações térmicas e energéticas. Próximos passos estratégicos incluem avaliação de integração com pipelines existentes, treinamento de equipes para gerenciamento avançado e monitoramento contínuo para maximizar o retorno de investimento e competitividade no mercado.

Supermicro AS-4125GS-TNRT: desempenho máximo com AMD EPYC e 8 GPUs PCIe diretas No cenário atual de computação de alto desempenho, o Supermicro A+ Server AS-4125GS-TNRT representa uma plataforma projetada para cargas intensivas de IA, aprendizado profundo e análise de Big Data. Com suporte a até 8 GPUs PCIe diretas e processadores AMD EPYC™ 9004/9005, este sistema 4U equilibra eficiência térmica, densidade de processamento e confiabilidade corporativa — elementos essenciais para empresas que buscam maximizar throughput e reduzir latência em operações de larga escala. Mais do que um servidor GPU, o AS-4125GS-TNRT reflete a estratégia da Supermicro em oferecer arquiteturas flexíveis de interconexão CPU-GPU e uma fundação escalável para centros de dados modernos, integrando inovações em refrigeração, energia e segurança de firmware. Visão Geral do Produto: O sistema apresenta configuração dual-socket AMD EPYC™, 24 slots DDR5 até 6000 MT/s, e estrutura direta de conexão PCIe 5.0 x16, garantindo largura de banda total entre CPU e GPU. A inclusão de 4 baias NVMe e 2 SATA hot-swap reforça sua capacidade híbrida de armazenamento, adequada a pipelines de dados intensivos em tempo real. Este artigo examina em profundidade sua arquitetura técnica, implicações estratégicas e práticas recomendadas de implementação em contextos corporativos avançados. O Desafio Estratégico: Computação Acelerada em Escala A demanda por infraestrutura capaz de lidar com cargas de trabalho de IA, aprendizado profundo e HPC cresce exponencialmente. Empresas de pesquisa, engenharia e finanças enfrentam gargalos computacionais que limitam a velocidade de inovação. O AS-4125GS-TNRT foi concebido para mitigar esses gargalos, combinando densidade de GPUs com arquitetura de interconexão otimizada. Os ambientes corporativos que dependem de treinamento de modelos de IA e análises preditivas exigem servidores capazes de manter alto desempenho sustentado sob cargas constantes. O desafio está em manter eficiência térmica e estabilidade elétrica em sistemas com GPUs de 400 W e processadores de 400 W TDP — algo que o design 4U com oito ventoinhas heavy-duty e controle PWM dinâmico aborda de forma exemplar. Impactos Técnicos e de Negócio Do ponto de vista empresarial, cada segundo de processamento reduzido em treinamento de modelo representa vantagem competitiva. Em aplicações de HPC e simulação científica, a latência entre CPU e GPU determina diretamente o tempo de convergência. Por isso, o uso de PCIe 5.0 x16 direto elimina camadas de comutação intermediária e reduz overhead, resultando em menor latência de comunicação e melhor eficiência energética por tarefa. Consequências da Inação Ignorar a necessidade de infraestrutura otimizada para IA e HPC significa aceitar custos de ineficiência computacional. Ambientes que operam com servidores de gerações anteriores, limitados a PCIe 4.0 ou DDR4, enfrentam gargalos sérios em throughput e largura de banda de memória. O atraso na atualização da infraestrutura não apenas impacta a produtividade técnica, mas também compromete a competitividade em setores orientados por dados, onde o tempo de inferência e o ciclo de aprendizado de modelos determinam resultados financeiros. O AS-4125GS-TNRT reduz esses riscos ao combinar interconexão direta CPU-GPU com suporte a até 6 TB de memória DDR5 ECC, ampliando o volume de dados manipulável por ciclo. Fundamentos da Solução: Arquitetura Direta e Alta Eficiência O cerne técnico do AS-4125GS-TNRT é a configuração de conexão direta PCIe 5.0 entre CPU e GPU, eliminando gargalos de intermediação. Essa topologia maximiza o throughput entre os processadores AMD EPYC™ 9004/9005 e GPUs NVIDIA ou AMD, garantindo uso integral dos 16 canais PCIe por GPU. A arquitetura dual-socket com suporte a até 160 núcleos e 512 MB de cache por CPU permite processar simultaneamente múltiplas cargas paralelas, tornando o sistema ideal para treinamento de redes neurais, renderização 3D e modelagem científica. O sistema suporta GPUs NVIDIA H100, A100, L40S e RTX PRO 6000 Blackwell, bem como GPUs AMD Instinct MI210 e MI100, oferecendo flexibilidade em ambientes híbridos de pesquisa e produção. A compatibilidade opcional com NVLink e Infinity Fabric Link possibilita a interligação direta GPU-GPU, potencializando desempenho em frameworks distribuídos. Eficiência de Memória e Armazenamento Com até 24 slots DIMM DDR5 ECC, o servidor alcança latência mínima e maior confiabilidade em operações críticas. O uso de DDR5 a 6000 MT/s em processadores EPYC 9005 assegura throughput contínuo mesmo sob cargas de inferência paralela. Já as baias frontais NVMe hot-swap otimizam o acesso a datasets massivos, simplificando manutenção e expansão sem downtime. Implementação Estratégica: Integração e Escalabilidade Ao adotar o AS-4125GS-TNRT, a organização deve considerar não apenas o desempenho isolado do sistema, mas sua integração com clusters existentes. A presença de interfaces 10GbE duplas e BMC dedicado simplifica a orquestração via ferramentas como SuperCloud Composer® e Supermicro Server Manager (SSM). Para operações críticas, recomenda-se configurar as fontes de energia redundantes 4×2000W Titanium Level (96%) em modo (3+1), garantindo resiliência em data centers de alta densidade. O gerenciamento térmico via sensores PWM e monitoramento ativo de voltagem e temperatura assegura longevidade operacional mesmo sob carga total. Interoperabilidade e Gerenciamento O conjunto de ferramentas SUM, SD5 e SAA automatiza updates de firmware, diagnóstico offline e manutenção preventiva, reduzindo janelas de indisponibilidade. Recursos de segurança como Trusted Platform Module (TPM) 2.0 e Silicon Root of Trust (NIST 800-193) consolidam a integridade da cadeia de suprimentos e a proteção do firmware contra adulterações. Esses mecanismos garantem que o sistema mantenha conformidade com políticas corporativas de segurança, suportando Secure Boot, assinaturas criptográficas e recuperação automática de firmware. Melhores Práticas Avançadas Para maximizar a eficiência do AS-4125GS-TNRT, é fundamental alinhar hardware e software sob uma mesma estratégia de desempenho. Em ambientes de IA distribuída, a adoção de NVLink ou Infinity Fabric Link reduz latência inter-GPU, otimizando frameworks como TensorFlow, PyTorch e ROCm. Recomenda-se ainda configurar perfis de ventilação adaptativos via firmware para adequar o resfriamento ao tipo de GPU instalada — passiva ou ativa — mantendo o equilíbrio térmico ideal. A estrutura modular permite que o sistema opere em faixas de temperatura de 10°C a 35°C sem perda de eficiência, mesmo em racks densos. Além disso, a integração com plataformas de gerenciamento remoto possibilita telemetria contínua e alertas proativos de falha, permitindo ações preditivas antes que ocorram interrupções críticas. Medição de Sucesso A eficácia