Servidores de IA Supermicro: portfólio INNOVATE 2025 para data center e edge

Servidores de IA Supermicro no INNOVATE 2025: infraestrutura avançada para data center e edge

A Supermicro apresentou no evento INNOVATE! EMEA 2025 um portfólio ampliado de servidores de IA, combinando GPUs NVIDIA de última geração, processadores Intel Xeon 6 e soluções modulares para cargas de trabalho críticas em data center e edge. Este artigo aprofunda o contexto, desafios e implicações estratégicas dessa evolução.

Introdução: a nova fronteira da infraestrutura de IA

O crescimento exponencial da inteligência artificial não é mais um fenômeno restrito a empresas de tecnologia. Hoje, praticamente todos os setores — de telecomunicações a varejo, de saúde a energia — enfrentam a necessidade de processar modelos complexos de IA com rapidez e eficiência. Neste cenário, os servidores de IA Supermicro desempenham um papel estratégico ao fornecer plataformas capazes de sustentar desde treinamento em data centers até inferência na borda.

O anúncio da Supermicro no INNOVATE! EMEA 2025, realizado em Madri, evidencia essa transição. A empresa apresentou sistemas otimizados para cargas de trabalho distribuídas que incorporam componentes de ponta, como GPUs NVIDIA RTX Pro™, NVIDIA HGX™ B300, soluções em escala de rack GB300 NVL72 e processadores Intel Xeon 6 SoC. A inclusão de arquiteturas voltadas para edge computing, como o NVIDIA Jetson Orin™ NX e o NVIDIA Grace C1, demonstra uma abordagem integral, capaz de atender tanto o núcleo do data center quanto as fronteiras de rede.

As organizações enfrentam hoje um dilema: investir em infraestruturas preparadas para a IA ou correr o risco de perder competitividade. A inação significa lidar com gargalos de rede, custos energéticos crescentes e decisões lentas. O portfólio revelado pela Supermicro busca mitigar esses riscos ao oferecer plataformas modulares, escaláveis e energeticamente eficientes.

O problema estratégico: demandas crescentes de IA no data center e na borda

A transformação digital acelerada fez com que os volumes de dados crescessem de forma descontrolada. Modelos de IA de larga escala, que antes eram restritos a poucos laboratórios de pesquisa, agora estão sendo aplicados em ambientes corporativos e operacionais. Isso cria dois desafios simultâneos: a necessidade de infraestrutura massiva em data centers e a urgência de capacidades de processamento diretamente na borda da rede.

No núcleo do data center, os requisitos envolvem treinamento de modelos cada vez mais complexos, que exigem clusters de GPUs interconectados com alta largura de banda e baixa latência. Já no edge, os cenários são diferentes: dispositivos precisam inferir em tempo real, com restrições severas de energia, espaço e conectividade. A convergência desses dois mundos exige soluções arquitetadas de forma modular, capazes de equilibrar desempenho, eficiência e escalabilidade.

Os servidores de IA Supermicro apresentados em Madri respondem a esse problema estratégico. Ao integrar desde sistemas de 1U de curta profundidade até racks completos com suporte a até 10 GPUs, a empresa constrói um ecossistema que permite às organizações implantar IA onde ela gera maior valor.

Consequências da inação: riscos de não modernizar a infraestrutura

Ignorar a modernização da infraestrutura para IA implica em riscos claros. Primeiramente, há a questão do desempenho. Modelos de IA mal suportados levam a tempos de resposta lentos, que podem inviabilizar aplicações críticas, como análise em tempo real em telecomunicações ou sistemas de recomendação em varejo.

Outro fator é o custo energético. Data centers que continuam operando apenas com refrigeração tradicional e servidores de gerações anteriores enfrentam contas de energia crescentes. A Supermicro destacou que muitos de seus novos sistemas podem reduzir em até 40% o consumo energético com soluções de resfriamento líquido — uma diferença que, em escala, representa milhões de dólares anuais.

Além disso, há a dimensão competitiva. Empresas que não conseguem treinar e rodar modelos de IA com eficiência ficam para trás em inovação. Isso significa perda de clientes, de relevância de mercado e, em última instância, de receita. A falta de infraestrutura adequada também impacta a capacidade de atender requisitos de compliance e segurança, especialmente em setores regulados.

Fundamentos da solução: arquitetura modular da Supermicro

A resposta da Supermicro para esses desafios é baseada em seu modelo de Server Building Block Solutions®, que permite construir sistemas sob medida a partir de blocos modulares. Essa abordagem garante que cada cliente possa alinhar sua infraestrutura às necessidades específicas de carga de trabalho, seja em termos de CPU, GPU, armazenamento, rede ou refrigeração.

No segmento de GPUs, os novos sistemas incorporam a mais recente geração da NVIDIA, incluindo a plataforma HGX B300 e a solução em escala de rack GB300 NVL72. Essas arquiteturas foram desenvolvidas para cargas de trabalho massivas, com múltiplas GPUs operando em paralelo e otimizadas para treinamento de IA em larga escala. Já no edge, a presença do NVIDIA Jetson Orin NX e do Grace C1 mostra que a empresa não limita sua visão ao data center, mas estende-a para cenários distribuídos.

Outro elemento-chave é a integração com processadores Intel Xeon 6 SoC. Esses chips oferecem até 64 núcleos e recursos específicos para telecomunicações, como o vRAN Boost integrado. A combinação com sincronização de tempo GNSS e múltiplas portas de rede de alta velocidade garante que os sistemas estejam prontos para aplicações em redes de alto tráfego.

Implementação estratégica: sistemas apresentados no INNOVATE 2025

ARS-111L-FR: IA para telecomunicações

O ARS-111L-FR representa a abordagem da Supermicro para ambientes de telecomunicações, onde espaço e eficiência energética são cruciais. Equipado com a CPU NVIDIA Grace C1 e suporte a GPUs de baixo perfil, ele oferece capacidade de IA diretamente em gabinetes de telecom. Isso permite que operadoras integrem serviços inteligentes na borda sem depender do data center central.

ARS-E103-JONX: IA compacta para varejo e manufatura

O ARS-E103-JONX é um exemplo claro de como a Supermicro traduz necessidades de edge em soluções práticas. Sem ventoinha e alimentado pelo Jetson Orin NX, o sistema oferece até 157 TOPS de desempenho, com conectividade avançada que inclui Ethernet de 10 Gb, 5G e Wi-Fi. Em ambientes de varejo, pode suportar múltiplos pipelines de visão computacional para monitoramento de estoque ou comportamento do consumidor em tempo real.

SYS-212D-64C-FN8P: redes de alto tráfego

Já o SYS-212D-64C-FN8P foca em locais de rede de alta densidade. Com 64 núcleos Intel Xeon 6 SoC, integração vRAN Boost e até 8 portas de 25 GbE, é um sistema desenhado para telecomunicações que precisam processar volumes massivos de dados com precisão temporal. Essa combinação garante qualidade de serviço em redes móveis de última geração.

Melhores práticas avançadas: otimização e sustentabilidade

A adoção de servidores de IA não deve se limitar à aquisição de hardware. Há práticas avançadas que determinam o sucesso da implementação. Entre elas, destaca-se o uso de refrigeração líquida, capaz de reduzir custos operacionais em até 40%. Essa tecnologia não apenas diminui a fatura de energia, mas também contribui para metas de sustentabilidade corporativa.

Outro ponto é a modularidade. Ao adotar o modelo Building Block, empresas conseguem evoluir sua infraestrutura sem substituições completas, reduzindo desperdício e otimizando investimentos. Essa flexibilidade permite ajustar sistemas para novas cargas de trabalho de IA sem reestruturar todo o data center.

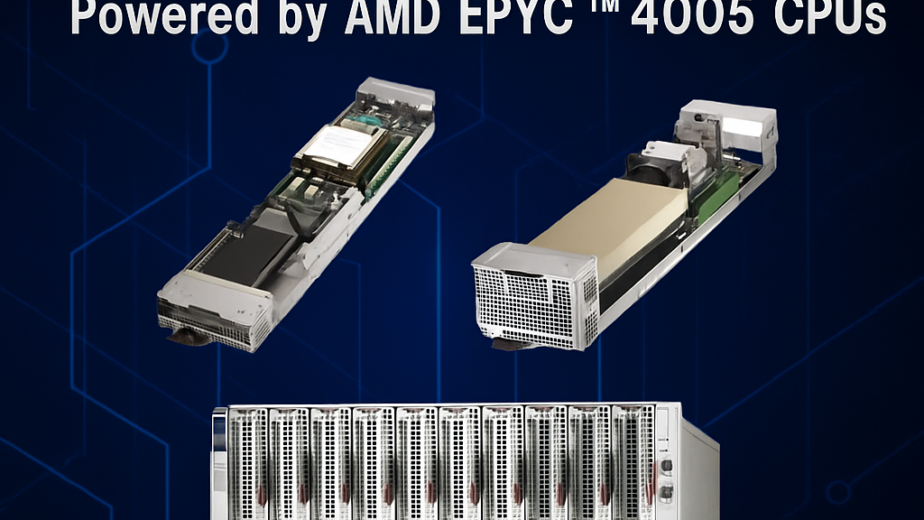

Por fim, a interoperabilidade com parceiros estratégicos como AMD, Intel e NVIDIA assegura que os sistemas Supermicro estejam sempre alinhados às inovações mais recentes do mercado, evitando obsolescência prematura.

Medição de sucesso: métricas para avaliar servidores de IA

Implementar infraestrutura de IA é apenas o primeiro passo. A eficácia deve ser medida com indicadores claros. No caso dos servidores Supermicro, métricas de sucesso incluem:

- Eficiência energética: monitorar redução percentual no consumo após adoção de sistemas com refrigeração líquida.

- Tempo de treinamento: avaliar a redução no tempo necessário para treinar modelos complexos em relação à geração anterior de hardware.

- Latência de inferência: medir a capacidade dos sistemas edge de responder em tempo real, especialmente em cenários críticos como telecom e varejo.

- Escalabilidade: verificar facilidade de expansão modular e integração de novos componentes sem interrupções operacionais.

A análise dessas métricas permite justificar investimentos e alinhar a evolução da infraestrutura aos objetivos estratégicos da organização.

Conclusão: rumo à próxima geração de infraestrutura de IA

O INNOVATE! EMEA 2025 mostrou como os servidores de IA Supermicro estão preparados para atender às demandas do presente e do futuro. Seja em data centers massivos ou em ambientes restritos de edge computing, o portfólio apresentado combina desempenho, modularidade e eficiência energética.

As empresas que adotarem essa infraestrutura estarão mais bem posicionadas para enfrentar o crescimento exponencial de dados, reduzir custos operacionais e acelerar a tomada de decisões. A convergência entre GPUs NVIDIA de última geração, processadores Intel Xeon 6 e a arquitetura modular Building Block Solutions cria uma base sólida para aplicações críticas.

O futuro aponta para uma maior integração entre borda e núcleo do data center. Nesse cenário, a Supermicro demonstra capacidade de entregar soluções sustentáveis, escaláveis e alinhadas às tendências de IA. O próximo passo para organizações interessadas é avaliar seus requisitos de carga de trabalho, mapear gargalos atuais e projetar uma adoção progressiva das soluções apresentadas no INNOVATE 2025.